一听“范畴论 + AI”,很多人会条件反射:又来一套高级包装。

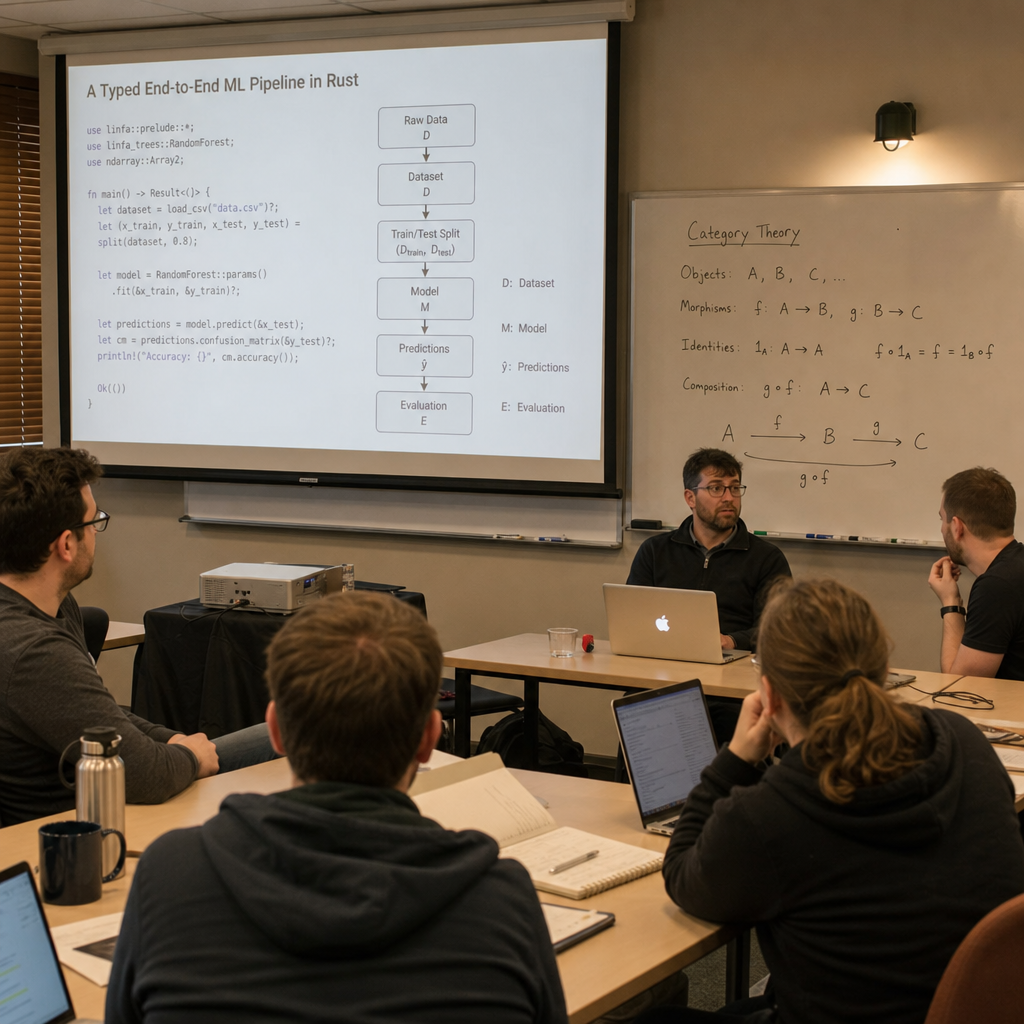

这次稍微不一样。《Category Theory for Tiny ML in Rust》目前是一份开放访问 working draft。它没有发布成熟 ML 框架,也没有宣称让模型更聪明。它做的是一件更窄、更硬的事:把范畴论里的对象、态射、组合,落到 Rust 类型、变换函数和 tiny ML 训练管线里。

我更在意这一点。AI 圈不缺会画箭头的人,缺的是能把箭头变成代码约束的人。

这份草稿到底给了什么

它给的是一套学习和实验材料。

读者可以看在线书,克隆公开仓库,运行 Rust 示例,也可以通过 GitHub 提交基于证据的反馈。反馈最好具体到章节、命令、源码文件或术语问题,而不是一句“这个方向不错”。

需要先把边界说清楚:它仍是 working draft。章节、代码、术语、图示和参考文献都可能继续变化。目录里有 roadmap,但目前主体是 tiny ML 与 Rust 的结构化示例,不是已经完成的 Transformer 框架。

它的核心对应关系很直白:

| 范畴论概念 | Rust / ML 对应 | 工程含义 |

|---|---|---|

| domain objects | Rust types | 数据、状态先被类型框住 |

| morphisms | typed transformations | 变换要有可检查接口 |

| composition | executable program structure | 组合关系落成可执行程序 |

| training | repeated transformation of model state | 训练被看成模型状态的重复变换 |

这张表就是它最有价值的地方。不是把数学词贴到 AI 上,而是把 ML 管线拆成一组可命名、可组合、可检查的部件。

两位作者的背景也解释了这个取向。一端偏生产级 GenAI、可靠架构、审计和 Rust 系统;一端偏范畴论、逻辑、语义、证明论和类型理论。一个关心系统能不能跑进生产,一个关心概念别被讲糊。

还有一个容易踩坑的点:open access 不等于无限制复用。个人学习、引用、链接、克隆和运行示例可以做;公司培训、组织工作坊、课程材料、改编讲义等组织性使用,需要书面许可。免费可读,不是版权真空。

对读者来说,这决定了该怎么用它。

Rust / ML 开发者可以把它当成结构化练习,跑示例、看类型设计、提 issue。企业培训方不要直接拿去改成内训课件,先看许可。研究者也别急着把它引用成“新框架”,目前更合适的定位是开放草稿和教学实验。

范畴论在这里是工具,不是性能神药

我不太买账“范畴论会提升模型智能”这类说法。至少这份材料不是这个路线。

它真正处理的是 AI 工程里的老问题:边界在哪里,状态怎么变,组合有没有规则,后来的人能不能读懂。

demo 阶段,脚本、胶水代码和口头约定往往够用。生产阶段就不够了。数据会变,状态会变,训练过程会变,监控和评估也会变。没有清楚边界,问题会沿着管线传染。

Rust 在这里不是装饰。它的类型系统、安全边界和显式约束,适合把隐含假设写出来。范畴论提供组合语言,Rust 提供执行刹车。

这不是说 Rust 天然适合所有 ML 场景。现实限制很清楚:主流训练生态仍在 PyTorch、JAX 等工具周围;Rust 示例更适合 tiny ML、系统边界、可维护性和类型实验。把它当替代训练框架,方向就错了。

这更像早期铁路。效率提升不只靠更强的蒸汽机,还靠轨距、信号、时刻表和调度制度。技术扩张到一定规模,秩序本身就是生产力。

“工欲善其事,必先利其器。”这里的器,不是新模型,而是约束。

接下来该看什么

这份草稿值不值得继续跟,不看口号,看几个变量。

| 观察变量 | 为什么重要 | 现在该怎么判断 |

|---|---|---|

| Rust 示例能否稳定运行 | 决定它是不是停留在概念展示 | 读者可直接跑示例、提交复现问题 |

| 章节和术语是否收敛 | working draft 最大风险是频繁改口径 | 适合学习,不适合当稳定教材引用 |

| GitHub 反馈是否具体 | 公开征集反馈要靠证据驱动 | 看 issue 是否落到代码、命令、章节 |

| roadmap 是否兑现 | Transformer 目前只是路线,不是成果 | 不应提前包装成完整框架 |

| 许可边界是否被尊重 | open access 容易被误读成全开放 | 组织培训和课程改编要先拿授权 |

最相关的两类人,动作也不一样。

对懂一点 Rust 和 ML 的开发者,它适合拿来做工具箱外的训练:看一套 ML 管线怎样被类型和组合约束起来。不要急着迁移项目,更不要把它塞进生产系统。先跑示例,读代码,挑边界。

对企业里的 AI 架构和培训负责人,它的价值在启发,不在直接采购。你可以借它检查自己团队的管线:数据对象有没有类型边界,状态变化有没有记录,训练和推理之间有没有可审计接口。但若要做内部课程或组织工作坊,许可先谈清楚。

这也是我觉得它值得写的原因。不是范畴论突然成了 AI 灵丹,而是 AI 工程正在从“能跑起来”转向“能被维护”。

过去两年,行业太迷恋 demo。能演示,能截图,能接 API,就算赢了一半。现在账开始回来:谁负责复现?谁解释状态变化?谁审计训练过程?新人接手时,是读代码,还是考古?

模型越来越强,系统不能继续靠隐含约定活着。

这份 working draft 还粗糙,还会改,也不该被神化。但它至少把一件事摆上桌面:抽象如果不能钉进代码,就只是漂亮词。钉进去了,才可能变成工程纪律。