人工智能资讯

聚合当前分类下的最新内容,按时间顺序查看第 1 页精选文章。

Bonsai Image 4B:4B 图像模型开始挤进 iPhone,但还没到放心迁移

PrismML 发布 Bonsai Image 4B,把 FLUX.2 Klein 4B 的扩散 Transformer 从 7.75GB 压到 0.93GB 和 1.21GB,并开放 Apache 2.0 权重与代码。 更重要的是,它让 4B 级图像生成模型在 iPhone、Mac 等本地设备上变得可运行,但这不是无损压缩。 对端侧 AI 应用开发者来说,ternary 更接近可用方案,1-bit 更像体积优先方案;是否迁移,还要看第三方复现、连续运行和真实功耗。

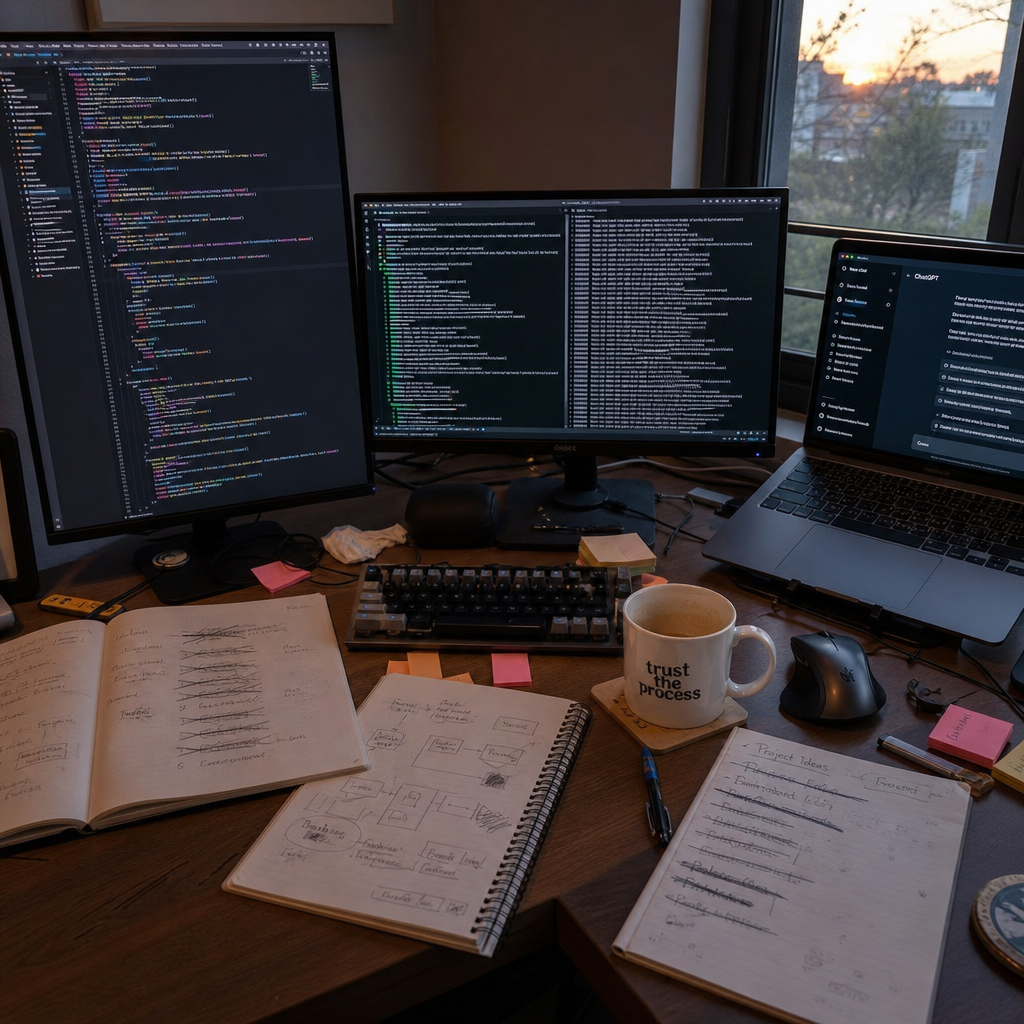

AI 编程太顺手,开发者开始制造无用项目

一位重度使用 Claude 和 Codex 的开发者复盘:他用 AI 做出 Rust 语音识别、新闻站、SaaS、游戏、克隆工具等一串项目,但多数无用,也没人维护。问题不在模型不够强,而在生成成本太低,把开发者从解决问题推向制造新项目。对重度用户和技术管理者来说,接下来该看的不是代码产量,而是维护责任、取舍机制和注意力是否被重新夺回。

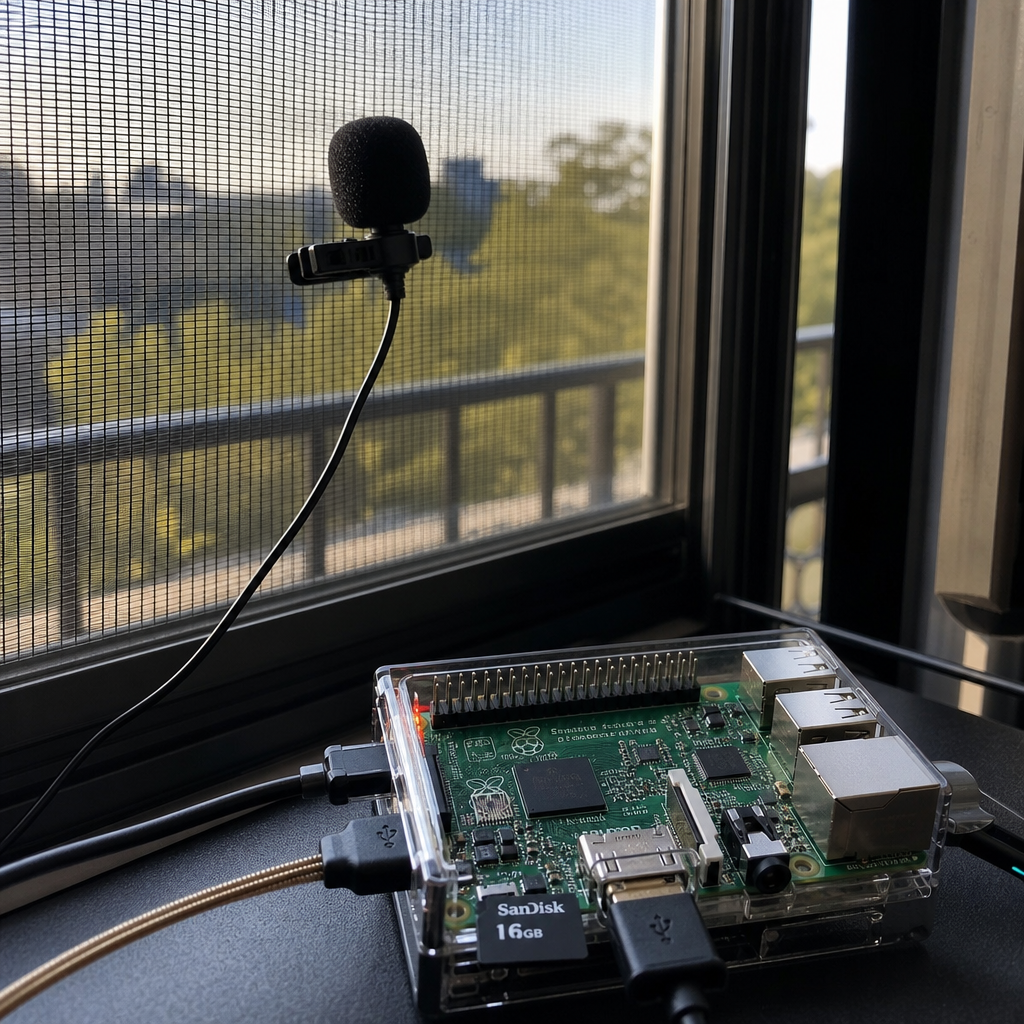

80 美元的阳台鸟站,比一堆 AI 硬件更像未来

Teddy Warner 做的 Avian Visitors,是一个基于 BirdNET-Pi 的个人开源项目:树莓派、USB 麦克风和 Gemini 插画,拼出一个阳台鸟类识别网页。它不是消费级新品,也没有公布神奇准确率;真正有意思的是,低成本 AI 和家居传感器正在把自然观察变成普通人能部署的小型基础设施。

LangGraph 不是默认答案,Agent 工作流上线前先补验证层

LangGraph 的价值不在“更像 AI”,而在能处理有状态、多步骤、条件分支和可恢复的工作流。简单流程用普通 Python,确定性数据管线用 Airflow 或 Prefect,往往更省事。真正决定企业能否上线的,是状态 schema、错误边界、人审节点和独立验证层,而不是 demo 跑通。

AI 让平台更容易做出来,ClaudeFolio 卡在了没人看见

ClaudeFolio 已上线数周,功能可用,但日均约 50 名访客,注册很少。它说明的不是产品已经失败,而是 AI 编程降低开发门槛后,独立开发者的新瓶颈转向分发。 旧互联网的空白赛道、开放社交流量和搜索红利很难复制。对 AI 工具创业者来说,接下来要少一点“再加功能”,多一点长期内容、社区参与、可分享设计和小额获客测试。

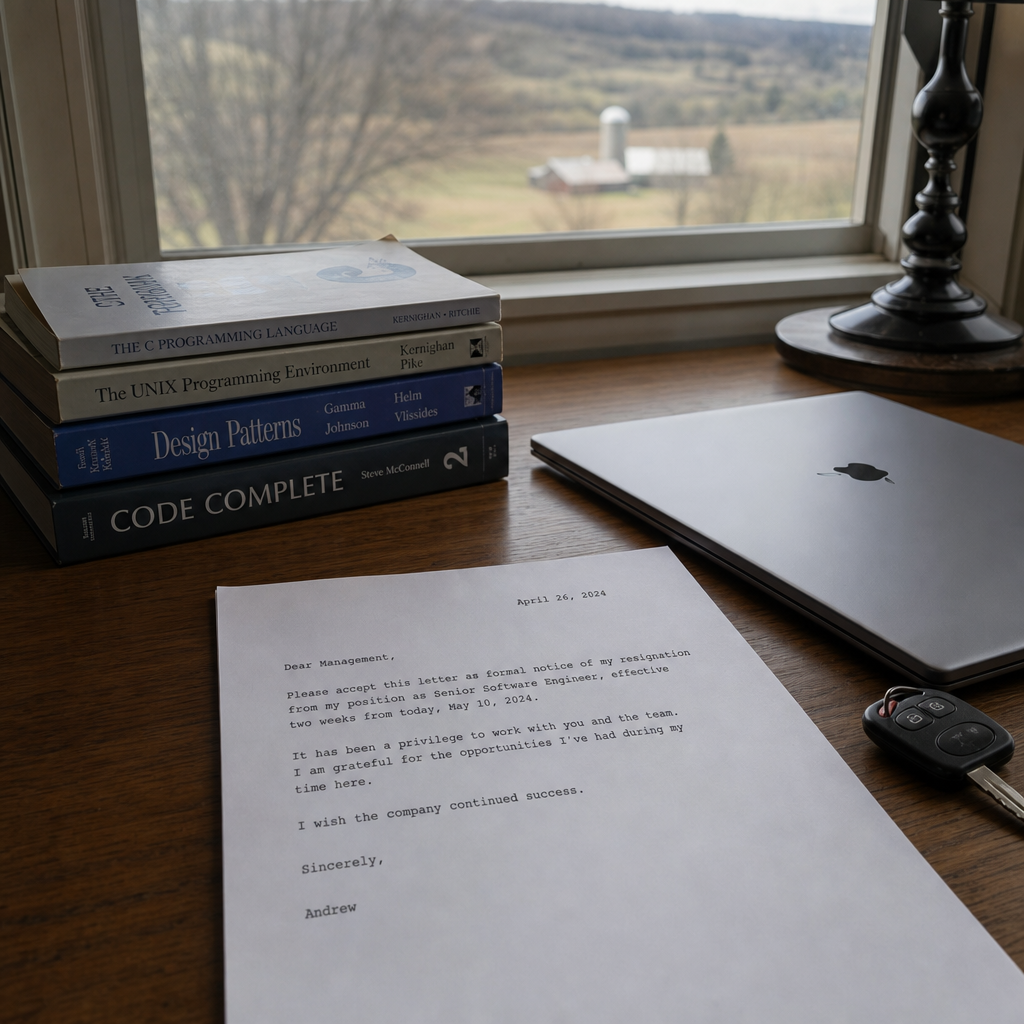

开源老兵 Chad Whitacre 退场:AI 是最后一根稻草,不是全部原因

Chad Whitacre 宣布退出科技行业,也包括开源圈,转向更离线的生活。他不是泛泛抱怨 AI 的网友,而是长期关注开源可持续性的人;这次退场更像一次用脚投票。真正刺痛人的不是 AI 会写代码,而是 AI 编程工具把注意力、劳动节奏和开源秩序进一步推向平台控制。

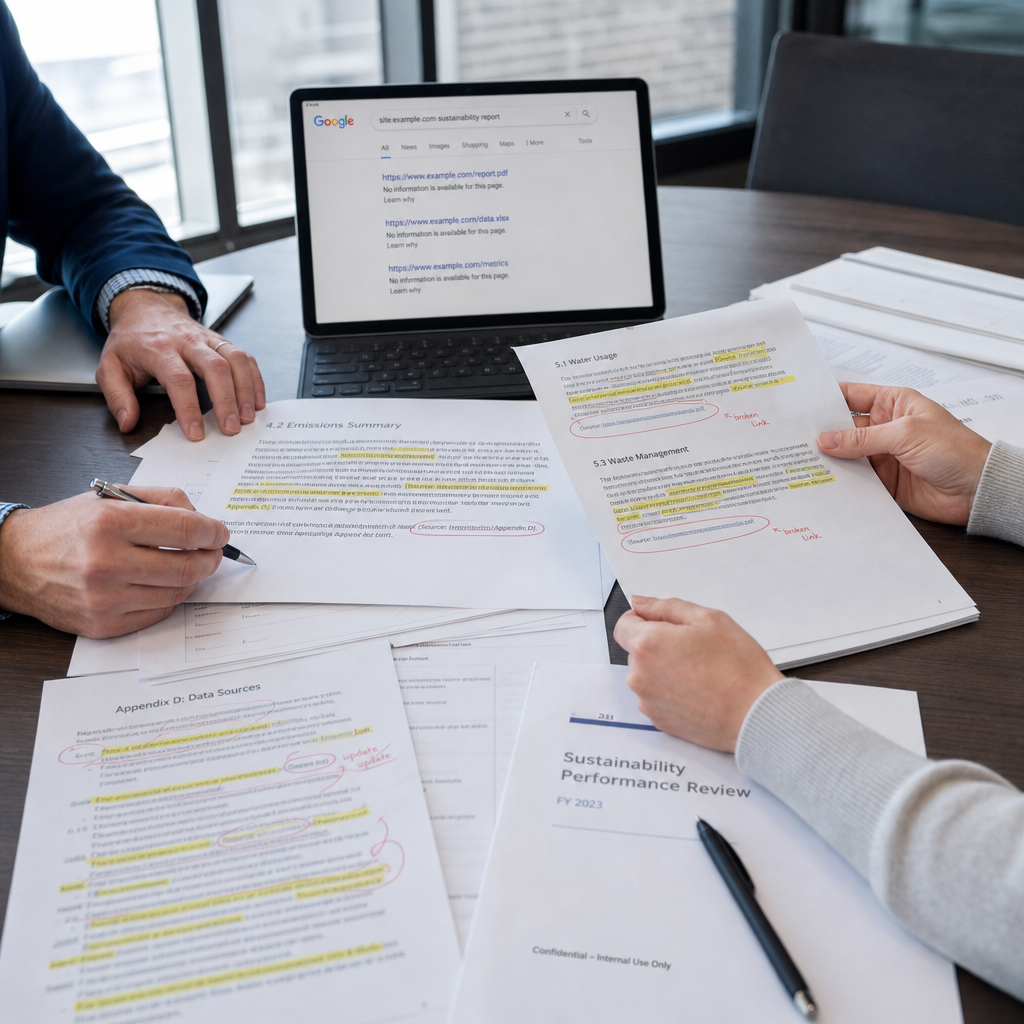

安永加拿大报告被指虚假引用:AI 时代,咨询报告也要查脚注了

GPTZero 指称,EY Canada 2025 年发布的《Points of Attack》报告存在大量疑似 AI 幻觉引用、错引和前后矛盾数据。 关键风险不在几个链接失效,而在知名咨询报告会被媒体、搜索、AI 摘要和企业内参继续引用。 GPTZero 本身也在推广 Hallucination Check,读者应把这次调查当作有利益相关的线索,而不是监管结论。

AI 争论最坏的地方:两边都太确定

Daniel Jalkut 说,反对 AI 的人太反对,支持 AI 的人也太支持;Simon Willison 收录了这句话,链条来自 John Gruber 转引。它不是模型发布,也不是公司新闻,却点中了 AI 舆论的病灶:立场跑得太快,判断跟不上。真正受影响的是开发者、内容创作者和要制定 AI 规则的组织,他们需要的不是站队,而是边界、责任和成本核算。

Meta据称在做AI吊坠,难点不是戴上去,是让人愿意被记录

The Information称,Meta内部备忘录显示公司正在开发一款AI吊坠,并计划明年开始测试;Meta尚未公开确认。它可能延续Limitless的可穿戴记录能力,但真正的门槛是隐私、用途和信任。对AI硬件玩家来说,眼镜和企业场景也许比大众吊坠更有机会。

AI 假卖家在哭着带货:身份叙事被做成了转化率工具

The Verge 发现,TikTok、Facebook、Instagram 上出现一批疑似 AI 生成的黑人女性卖家,用哭诉、手工创业和种族身份销售低价代发商品。Aliyah 案例里,所谓手工皮带扣在 Shein 上能找到同款,价格约为 TikTok 店铺的四分之一。真正的问题不止是假货带货,而是平台激励正在奖励“可复制的同情心”。

Chrome、Safari 之外,浏览器竞争的新变量是 AI、隐私和注意力

TechCrunch 梳理了 2026 年一批挑战 Chrome 和 Safari 的替代浏览器,主要分成 AI、开源/隐私、正念浏览器三类。Chrome 和 Safari 仍是主导者,新浏览器更像在撬缝隙,而不是马上改朝换代。真正的变化是:浏览器竞争正在从速度和兼容性,转向 AI 代理能力、数据边界和注意力管理。

MCP 没死,但默认接入该停一停了

Quandri 在 Claude Code 工作流里测到,4 个 MCP server 的工具定义一度占约 21K tokens,同一 Linear issue 查询比 CLI 路径多约 65 倍 token。这个案例不能推出 MCP 已死,只能说明一件事:把 MCP 当默认连接层,工程成本很容易被藏起来。对工程团队来说,更现实的做法是日常任务先用 CLI 和 Skills,MCP 留给无 CLI、统一认证、权限治理和生产环境护栏。

别再用“人类写得更好”证明人有价值了

noperator.dev 的短文反驳了一种 AI 时代常见安慰:别把人的价值押在“人类暂时比 AI 写得好”上。 真正的分水岭不是 AI 能不能创作,而是人类尊严一旦被改写成性能竞赛,就已经落进了机器逻辑。 对内容创作者、产品经理和团队管理者来说,接下来要调整的不是口号,而是 AI 使用规则:保留意图,标清责任,别把低意图形式当成沟通。

程序员离不开 AI 写码后,维护账单开始上桌

到 2026 年,AI 编程工具已经从辅助选项变成默认装备,METR 甚至难以招到愿意不用 AI 的开发者做复现实验。多项研究和企业案例指向同一个风险:代码生成更快,不等于质量更好、成本更低。真正该算的不是 token 用了多少,而是缺陷率、返工时间、审查成本和后续维护债。

AI 术语越用越乱,TechCrunch 做了一份给非专家看的校准表

TechCrunch 发布并持续更新一份 AI 术语表,用通俗语言解释 AGI、AI agent、LLM、RAG、RLHF、幻觉、推理、微调等高频概念。它的价值不在爆料,而在给被行业话术包围的读者提供一把尺:哪些词已有相对清楚的工程含义,哪些仍处在营销、研究和产品定义混杂的灰区。

AI Agent 的持久工作流,不必一上来就搬出 Postgres

Obelisk 作者回应 DBOS:如果 Postgres 可以支撑 durable execution,那很多小型、实验性的 AI workflow,用 SQLite + Litestream + S3 也可能够用。关键不是 SQLite 取代 Postgres,而是别把“状态持久”误做成“整套基础设施常驻”。边界也要说清:Litestream 是异步备份,不是强一致高可用;不接受最新写入丢失的系统,仍该选 Postgres。

Groq再融6.5亿美元:AI芯片公司的牌桌,已经挪到推理云

据Axios报道,Groq正向现有投资者筹集6.5亿美元,资金指向inference neocloud业务,融资尚未正式完成。比金额更关键的是,Groq在与NVIDIA达成约200亿美元非完整收购安排后,留下来的公司主体正从“卖AI芯片”转向“卖推理云服务”。这条路有需求,但门槛不在芯片发布会,而在稳定交付、软件适配和企业采购信任。

OpenAI发布第三方AI评测指南:别再把前沿模型当聊天框打分

OpenAI发布第三方AI评测指南,要求报告说清测试主张、harness设置、测试预算和有效性风险。它指向一个现实问题:很多分数测到的不是模型“固定能力”,而是工具、脚手架、重试次数、污染和坏题共同塑造的结果。对AI安全评测团队和技术决策者来说,今后看报告不能只看榜单,要看它是否对应自己的真实风险场景。

Devin 融资到 260 亿美元估值后:AI 编程代理会替代程序员吗?

Cognition 两年内融资 10 亿美元、估值升至 260 亿美元,Devin 被推到“替代程序员”的争议中心。Scott Wu 对 TechCrunch 的说法更接近“是也不是”:Devin 能独立做部分开发任务,但定位是开发者伙伴,不是直接让程序员出局。真正要看的不是一句口号,而是它会不会先改写维护、迁移、遗留系统更新这些低创造性工作的分工。

波士顿儿童医院用 OpenAI 辅助罕见病诊断:重点不是试用 ChatGPT,而是把 AI 放进医院流程

波士顿儿童医院已把 OpenAI 技术用于临床、科研和运营,超过三分之一员工在日常工作中使用 AI。50 多项自动化累计节省约 6 万小时,相当于 700 多万美元可重新配置的人力。更关键的是,AI 正在从零散工具变成受治理约束的医院级能力,并已辅助医生完成 40 多例此前未解的罕见病诊断。

AI 代理开始操作桌面,Linux 的老短板换了考题

桌面系统的新考题,不只是人用起来顺不顺,而是 AI 代理能不能稳定读懂界面、合成输入、拿到权限。macOS 赢在默认控件自动生成较好的无障碍树,Windows 有成熟 UI Automation 但生态太杂,Linux 的问题则是跨桌面一致性和执行机制不足。对桌面 AI 代理、自动化测试和辅助技术团队来说,短期更现实的动作是谨慎押注 Linux 桌面适配,而不是假设一套接口能跑遍所有发行版。