人工智能资讯

聚合当前分类下的最新内容,按时间顺序查看第 1 页精选文章。

GRAI拿了900万美元,不想替你写歌,只想把“合法二创”做成下一代音乐入口

AI音乐初创 GRAI 完成 900 万美元种子轮,路线和 Suno、Udio 不一样:它不主打从零生成歌曲,而是想在授权前提下让用户 remix 现有音乐、变风格、再社交传播。真正值得看的是,这家公司押注的不是“AI替代创作”,而是“合法二创+社交分发+版税再分配”;但授权名单没公开、分账机制也未验证,这套故事离成型还差最硬的一步。

Yelp升级AI助手:能在一段对话里问完就订,但交易闭环还不在自己手里

Yelp 更新了 2024 年推出的 AI 助手,用户现在可以在同一段对话里查询餐厅或服务信息,并发起订位、下单或预约。问题在于,关键交易大多仍要跳转到 DoorDash、Grubhub、Vagaro、Zocdoc、RepairPal、Calendly 等外部服务完成,所以它更像聊天式分发层,不是已经跑通的完整 AI 代理。真正值得看的,是 Yelp 正把自己从评论平台往“答案+行动”平台挪,争的是本地生活入口和交易前置位。

codemix 发了个 TypeScript 图数据库,但更想抢的是 AI 上下文入口

codemix 发布了 `@codemix/graph`:有 schema 类型安全、Gremlin 风格遍历、Cypher-like 查询,还能把底层放进 Yjs CRDT,做实时协作和离线同步。真正值得看的是这套组合:图模型、协作状态层和 AI/agent 上下文被绑进同一栈里。问题也很直接:官方已明确它还是 alpha,目前看到的是功能拼装的方向感,不是成熟数据库替代品。

TII发了个阿拉伯语大模型榜单,真正被重排的是评测尺子

阿联酋 TII 在 Hugging Face 发布阿拉伯语大模型榜单 QIMMA,先清洗 14 个基准、109 个子集、超 5.2 万条样本,再重排 46 个开源模型。Jais-2-70B 以 65.81 排第一,Qwen2.5-72B 以 65.75 紧追,分差只有 0.06。真正值得看的是,QIMMA不是又发了一张榜,而是在修阿拉伯语评测里那把长期不太准的尺;可尺子更干净,不等于裁判就天然中立。

Moonshot 发布 Kimi K2.6:开源模型开始比 agent 落地,不只比榜单分数

Moonshot 发布开源权重模型 Kimi K2.6,账面配置包括 1T MoE、32B active、256K context、原生多模态和 INT4,主打长时 agentic coding,而不是普通聊天。更关键的是,它首日就接入 vLLM、OpenRouter、Cloudflare、Baseten、MLX 等生态入口,竞争焦点开始从“谁分高”转向“谁更快进部署栈、进产品后端”。我的判断是:K2.6 让 Moonshot 暂时站上中文开源头部,但这位置能不能坐稳,还得看社区复现、部署成本和竞品跟进。

华为 HiFloat4、Anthropic AAR、Kimi K2.5:AI 效率在猛冲,安全还没跟上

这期最该放在一起看的,不是三条零散新闻,而是一条更硬的产业线:算力受限在逼出效率创新,研究自动化开始吞掉一部分人工,对应的安全治理却明显慢半拍。华为在昇腾体系里用 HiFloat4 压过 MXFP4,Anthropic 证明特定对齐研究可半自动推进,Kimi K2.5 则把“能力逼近、护栏偏弱、政治审查更重”的不均衡状态摊开了。

Anthropic默认OpenClaw式Claude CLI复用可继续用,但正式、稳定的路仍是API

OpenClaw在其Anthropic接入文档中写明:Anthropic员工告知,OpenClaw风格的Claude CLI复用和`claude -p`用法“再次被允许”。但这不是Anthropic公开发布的正式政策,最多只能算第三方转述的口头放行。 对开发者来说,结论很简单:CLI复用现在看起来能继续用,尤其适合已登录Claude CLI的个人工作流;真要上生产、跑网关、签客户,API key仍是更清晰、可预测的路径。真正暴露出来的问题,不是接入技巧,而是平台解释权一直悬着。

Kimi K2.6、Qwen3.6-Max、Hermes同日加速:AI竞争正从榜单转向Agent运行时

Moonshot放出开源权重的Kimi K2.6,阿里预览Qwen3.6-Max,Hermes Agent生态继续扩张。三件事放在一起看,重点已不是谁的榜单分数更高,而是谁更能长时间跑任务、调工具、接入部署平台。对开发者和技术决策者来说,模型还是核心,但真正拉开差距的部分,正在下沉到runtime、memory、编排和平台入口。

阿里发布 Qwen3.6-Max-Preview:跑分是表面,真正想拿下的是开发者接入层

阿里通义发布了闭源托管模型 Qwen3.6-Max-Preview。它还是 early preview,已可在 Qwen Studio 体验,并将通过阿里云 API 以 qwen3.6-max-preview 提供。官方主打 agentic coding、知识能力和指令遵循提升,但这次更值得看的不是分数,而是阿里把闭源旗舰、兼容接口和 Agent 工作流一起推给开发者与企业客户。眼下能确认的是卡位动作,不是稳定、低成本、可大规模上线的定论。

arXiv 论文称 KV Cache 理论上可压 91 万倍:它改写了压缩对象,不是推翻香农

一篇单作者 arXiv 论文把 LLM 的 KV cache 压缩,从“逐向量量化”改成“按序列预测编码”,并据此推导出理论上可比 TurboQuant 高约 91.4 万倍的压缩上限。关键不在“91 万倍”这个标题数字,而在它把压缩问题从独立向量熵,换成了条件序列熵。现在能下的判断很简单:这是信息论上的上限宣言,不是已经跑通生产系统的工程胜利。

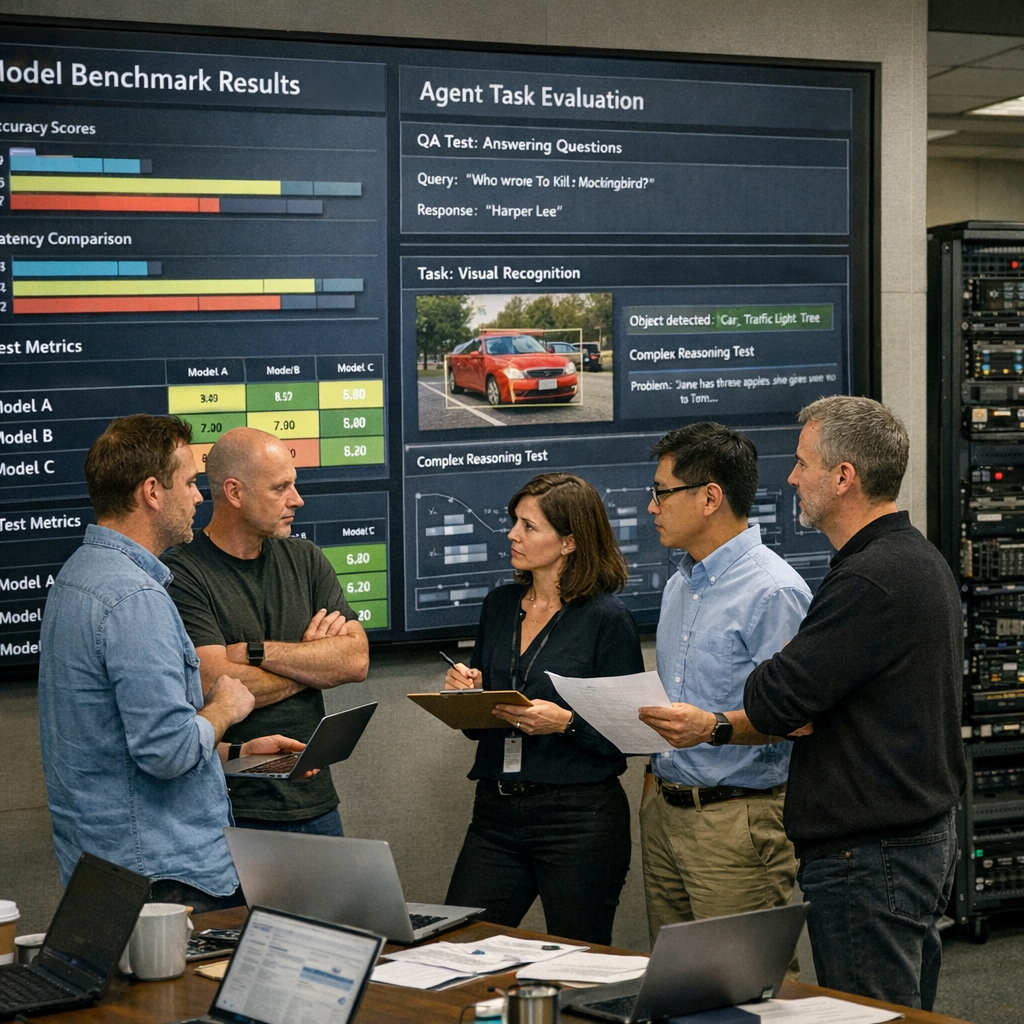

开源模型离闭源还差多远?别再迷信那一个总分榜了

开源模型和闭源前沿模型的差距还在,但今天最容易误读的地方,是大家总想用一个综合分数把这件事说完。真正拉开差距的,越来越不是通用聊天题,而是复杂编码、终端任务、长上下文和专业 agent 工作流背后的数据、环境与产品入口。企业采购更该算账:多出来的性能,到底是能力鸿沟,还是被评测设计和商业叙事一起放大的优势。

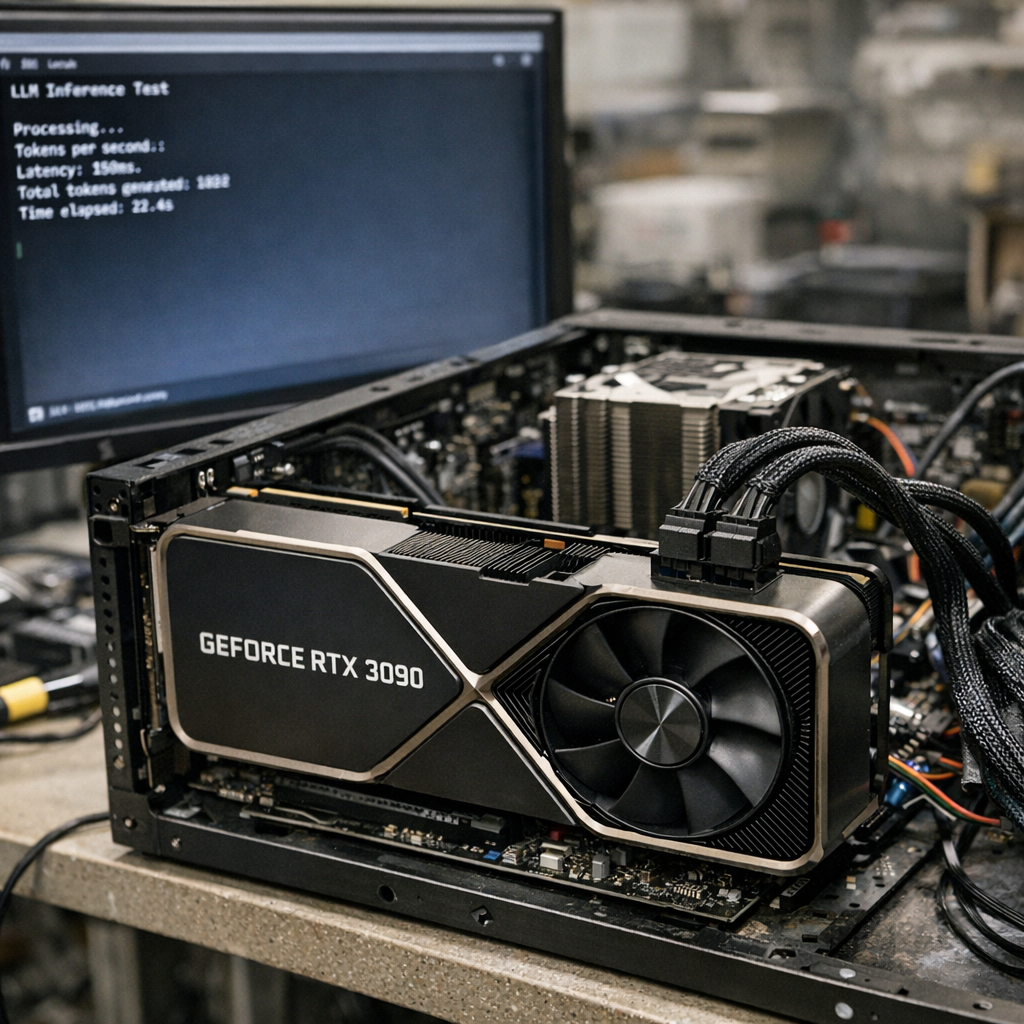

Lucebox在 RTX 3090 上把 Qwen3.5-27B 跑到 207 tok/s:问题开始指向通用推理栈

Lucebox 开源了一套面向特定消费级硬件手工优化的推理仓库,在单张 RTX 3090 上把 Qwen3.5-27B 的 GGUF 推理做到 demo 峰值 207.6 tok/s,HumanEval 均值 129.5 tok/s。更重要的是,它把一个老问题重新摆上台面:在消费级 GPU 上,通用推理框架可能一直丢掉了不少现成性能。可这条路也不轻松,成绩成立的前提很窄,维护成本也很高。

Noetik想用AI降低癌症试验95%失败率,但真正稀缺的不是模型,是病人分层

Noetik 这家做肿瘤基础模型的公司,正在押注一个不太讨喜但很关键的判断:很多癌症药不是没用,而是临床试验把“该用的人”和“能受益的人”配错了。GSK 掏出 5000 万美元签软件与模型授权,说明大药厂开始认真买“分层工具”而不只是买新药故事;但这件事的难点,仍然在真实世界验证,而不在演示里的模型曲线。

一份 nginx 日志,戳穿了 AI 搜索流量最爱混淆的账

一位站长用 nginx 访问日志做了件很朴素的事:直接看 ChatGPT、Claude、Perplexity 到底会不会在回答时抓取网页。结果不复杂,但很重要——AI 抓取和用户点击根本不是一回事,很多“AI 流量分析”产品却偏偏爱把它们算成一锅粥。Google 更特殊,它大多依赖 Googlebot 建好的搜索索引,所以你看不到一个叫“Gemini-User”的访客;这不是技术细节,而是平台权力藏身的地方。

Canva不想只做设计工具了,它要去抢“企业AI入口”

Canva CEO Melanie Perkins最新给公司的定义,不再是“带AI功能的设计平台”,而是“带设计工具的AI平台”。这句话听着像公关词,实则暴露了更大的野心:Canva要从做海报、PPT的软件,变成企业里帮你自动产出文档、演示和营销内容的工作入口。真正该盯的不是它会不会画得更快,而是它能不能把AI生成的东西变成可编辑、可协作、可管控的企业资产;做不到,这波AI升级就只是更贵的自动排版。

AI 不想再替你点网页了,SaaS 正在转向“无界面”服务

Simon Willison 转引的一篇文章提出,面向个人 AI 的“headless”服务会越来越多:应用不再把网页当主入口,而是把 API、CLI、MCP 直接交给 AI 代理调用。我认为这件事真正重要的,不是一个新术语,而是软件交互权正在从“人点按钮”转向“AI 调接口”,这会直接冲击按人头收费的 SaaS 商业模式。真正还不确定的,是企业愿不愿意把最核心的工作流和权限,放心交给代理自动执行。

北京机器人半马跑进50分钟,破的不是人类纪录,是真人形机器人的门槛

北京人形机器人半程马拉松出现了一个更值得行业盯住的数字:50分26秒。它确实快过了人类半马世界纪录,但真正重要的不是“机器人赢了人”,而是自主奔跑、稳定控制和整机可靠性一起跨过了一个工程门槛。对机器人公司、采购方和投资人来说,这场比赛更像一次公开压力测试,而不是体育意义上的较量。

AI 时代的新工种:当公司开始为模型错误安排“背锅的人”

技术作者 Kyle Kingsbury 提出一个刺耳但准确的判断:AI 普及后,会出现一批专门为机器决策承担责任的人,哪怕他们并不真正掌控系统。真正重要的,不是这个说法够不够尖锐,而是它点破了当前生成式 AI 落地中的核心矛盾——自动化在扩张,责任却无法自动化。短期内,这类岗位会继续增加,但如果企业只是把它当合规挡箭牌,而不给人足够权限,风险只会被推迟,不会被消除。

AI圈的“平静一天”里,真正有分量的不是新模型,而是新尺子和新底座

这一天看上去没有超级大模型炸场,但行业并不平静:ARC-AGI-3把争论重新拉回“模型到底会不会举一反三”,而一批代理基础设施产品则在回答更现实的问题——AI到底怎么进企业、怎么跑起来。我的判断是,今天最重要的不是谁又发了一个模型,而是评测标准和交付方式都在变,这会直接影响研发方向、采购决策和产品形态。

开源大模型追不上闭源?真正拉开差距的,可能不是参数而是钱和用户

关于开源模型能否追平闭源实验室,答案正在变得更具体:基准分数上的差距没想象中大,但真实产品能力和持续投入能力,仍站在闭源一边。眼下最重要的变量不是“谁更会训模型”,而是谁能从真实使用中赚到钱、拿到反馈,再把这套循环继续转下去。

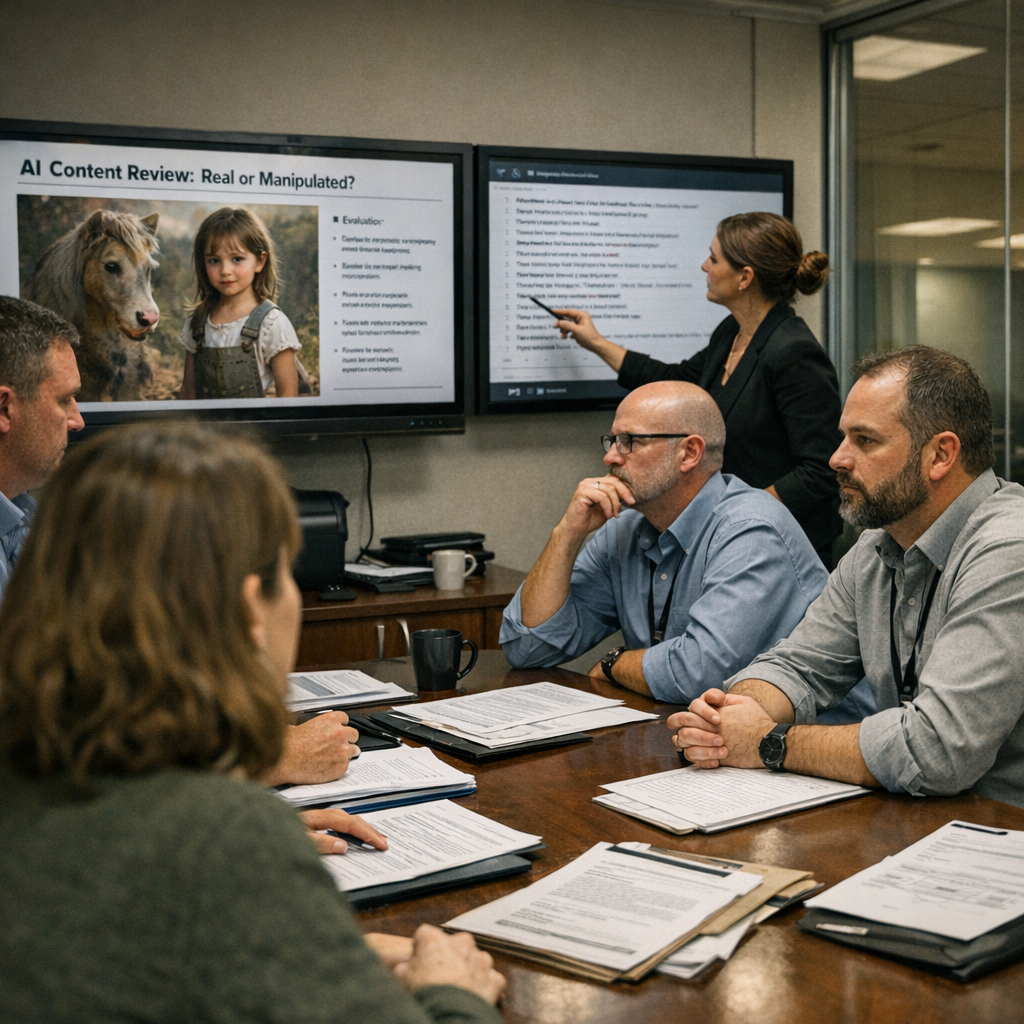

AI 已经会“照着功能抄软件”了,但真正更麻烦的是它开始自己上网做事

本周几项分散的 AI 研究,其实指向同一件事:模型的能力边界正在从“会写代码”推进到“能独立完成几周级任务”。我对这波进展的判断是,编码自动化比很多人预想得更近,但比能力增长更快暴露出来的,是代理型 AI 的安全和治理缺口。政策讨论也在升温,不过眼下最现实的问题不是“AI 会不会接管一切”,而是企业和开发者已经要开始重写工作流和风控规则了。