有用户发现,Chrome 不是多缓存了几个网页,而是在浏览器目录里塞进了一个约 4GB 的 weights.bin 文件。

4GB 放在今天不算天文数字。但问题不在大小本身,而在用户是怎么知道它存在的:很多人是硬盘空间突然少了一截,才一路翻目录,发现浏览器已经给本地 AI 留了座位。

The Verge 这次把几个细节说得更清楚,也让这件事不再只是“Chrome 又臃肿了”的老抱怨。

- 这个文件和 Google 的 Gemini Nano 有关。

- 它是本地模型权重/参数文件,不是训练数据。

- 它服务于 Chrome 的端侧 AI 功能,比如诈骗检测、写作辅助、自动填充、建议等。

- 并非所有 Chrome 用户都会自动下载,通常与开启某些 Gemini / On-Device AI 功能有关。

- Google 文档提到模型大小会随浏览器更新变化。

- 只删文件不可靠,相关功能还开着,之后可能重新下载。

这几个补充很重要。它把问题从“Google 是否偷偷下载”往后推了一步:平台在推本地 AI 时,到底有没有把成本讲清楚。

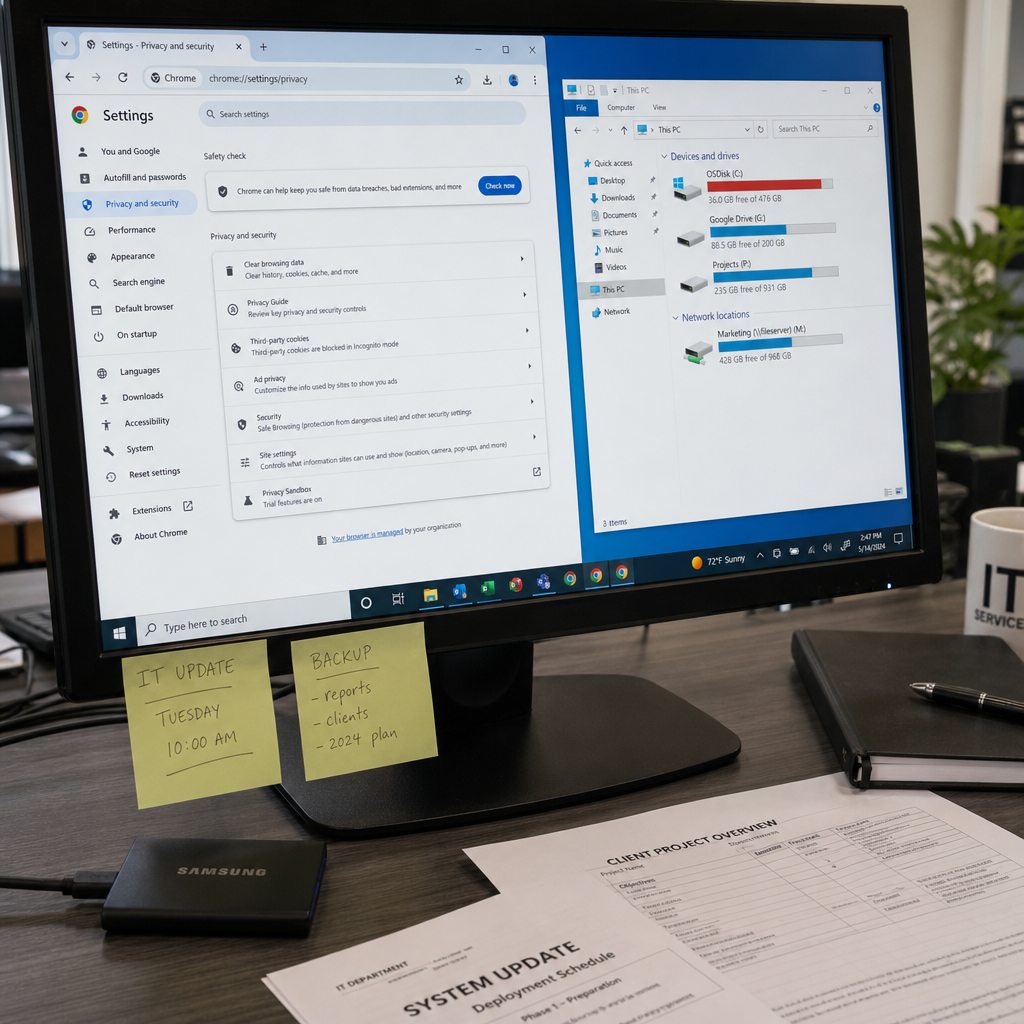

这 4GB 到底占在哪里

目前被用户提到最多的是 Chrome 数据目录里的 OptGuideOnDeviceModel,里面可能出现一个 weights.bin 文件,大小约 4GB。

它不是缓存垃圾,也不是网页临时文件。它更像是 Gemini Nano 在本机运行时需要的一块“模型砖”。浏览器要做本地推理,就得把模型权重放到你的设备上。

这件事有一个容易被误解的地方:本地 AI 不等于坏事。

诈骗检测放在本地做,网页风险判断可以更快。写作建议、自动填充、输入提示在本机跑,也可能减少数据外传。对隐私敏感任务来说,端侧模型有合理性。

但合理不等于可以无感。

对 1TB 台式机用户,4GB 可能只是一个大型游戏补丁的零头。对 128GB 或 256GB SSD 笔记本用户,这就是系统更新、照片库、开发环境和浏览器之间抢地盘。

受影响最明显的是两类人:

| 人群 | 影响 |

|---|---|

| 小容量 SSD 笔记本用户 | 空间突然减少,系统更新和应用安装更容易卡住 |

| 不想使用端侧 AI 的用户 | 可能在没充分理解代价前,为默认功能付出本地资源 |

如果你想检查,可以在 Chrome 数据目录里找 OptGuideOnDeviceModel。但别把删除 weights.bin 当成终点。

只要相关 AI 功能还开着,它就可能回来。更有效的动作是到 Settings > System,关闭 On-Device AI。

这一步才是关键。只教用户删文件,不告诉用户关开关,本质上是在安排循环劳动。

为什么这事比“Chrome 占空间”更重要

Chrome 臃肿,早就不是新闻。

真正的新变量是:浏览器正在从网页入口变成 AI 运行时。

以前浏览器主要下载页面、缓存图片、保存 cookie。现在它要下载模型权重,在本机跑推理,替你判断页面、补全文字、给建议、拦诈骗。

这条路不会只发生在 Chrome 上。Apple、Microsoft、Google 都在把 AI 往端侧推。原因也不复杂:云端推理贵,延迟敏感,隐私叙事又越来越难绕开。本地 AI 刚好能同时回答几道题。

只是成本换了地方。

过去 AI 的账单在云端:GPU、电力、机房、推理成本、订阅费。现在一部分账单被搬到用户设备上:硬盘、内存、电池、散热、设备寿命,还有理解设置选项的时间。

平台当然喜欢这条路。云端压力小一点,隐私故事好讲一点,浏览器也能更像操作系统一点。

用户也不是没有收益。问题只在告知。

“天下熙熙,皆为利来。”这句话放在这里很合适。平台推本地 AI,不是做慈善;用户享受更快、更私密的功能,也不是没有代价。好交易可以做,暗账不能藏。

同意权不能被塞进默认设置

我不太买账的是这种产品逻辑:先把 AI 功能包装成浏览器升级,再把真实成本藏在系统目录和说明文档里。

Google 文档里提到 Gemini Nano 大小可能变化,这当然比完全不说要好。但对普通用户来说,关键时刻不是开发者文档,而是打开功能的那一秒。

一个正常的提示应该很朴素:

- 这个功能会下载本地 AI 模型;

- 预计占用约 4GB,未来可能变化;

- 关闭后可删除模型文件;

- 本地处理和云端处理有什么区别;

- 哪些功能依赖这个模型,能不能拆开关。

这不复杂。复杂的是平台愿不愿意把转化率让出来一点。

默认开关是互联网产品最老的权力。浏览器战争、移动系统权限、通知推送、位置服务,套路反复出现:先默认拿到,再让用户自己找地方关。

AI 时代只是把这套老手艺换了皮。以前拿的是注意力、数据和通知栏。现在还要拿本地算力和存储空间。

这里不能把话说成 Google 已经恶意“偷吃硬盘”。从现有信息看,更稳妥的判断是:Chrome 的某些端侧 AI 功能可能触发模型下载,但用户侧的提示、可见性和可控性不够。

这已经够严重。

因为本地 AI 越贴身,越需要清楚的边界。一个浏览器如果能悄悄多出 4GB 模型文件,下一步就会有更多模型、更多组件、更多“为了体验”的默认占用。

模型看着更强,产品反而更虚。虚在用户不知道自己付了什么。

接下来该看什么

这件事后面不该只看 Chrome 会不会回应一句“为了更好体验”。那没什么信息量。

更该看三个具体动作。

一是开启前有没有明确提示空间占用。不是写在文档里,是写在用户点开功能的位置。

二是模型能不能按功能拆分。诈骗检测、写作辅助、自动填充不该被塞进一个含糊的 On-Device AI 大包里。用户可能想要安全检测,但不想要写作建议。

三是卸载路径是否干净。关闭功能后,模型文件是否自动清理;浏览器更新后,是否又把用户带回默认状态。

本地 AI 可以成为好功能。它能降低延迟,也可能改善隐私。但它必须接受一个更硬的产品伦理:越靠近用户设备,越不能替用户签字。

浏览器不是平台公司的仓库。用户设备也不是 AI 战略的免费边角料。

这件事真正提醒人的,不是 4GB 有多大,而是 AI 普及正在进入一个更隐蔽的收费阶段。钱未必从钱包里扣,可能从硬盘、电池和选择权里扣。

船可以上,船票要写清。