一个开发者在 Hacker News 上展示了一款小工具:它不是普通计算器,而是能对“多个彼此不相交的区间”做运算的计算器。原帖标题很直白,叫 Show HN: I made a calculator that works over disjoint sets of intervals。这类项目注定不会像 AI 助手或新硬件那样刷屏,但它碰到的问题,比大多数新功能都更基础:现实世界里的数,经常不是一个点,而是一段范围,甚至是几段互不相连的可能性。

我更愿意把它看成一次“数值诚实性”的提醒。很多软件、表格、建模工具和内部系统,最擅长的事情不是算错,而是把“不确定”包装成“已经算明白了”。这才是它真正危险的地方。

它到底解决了什么问题

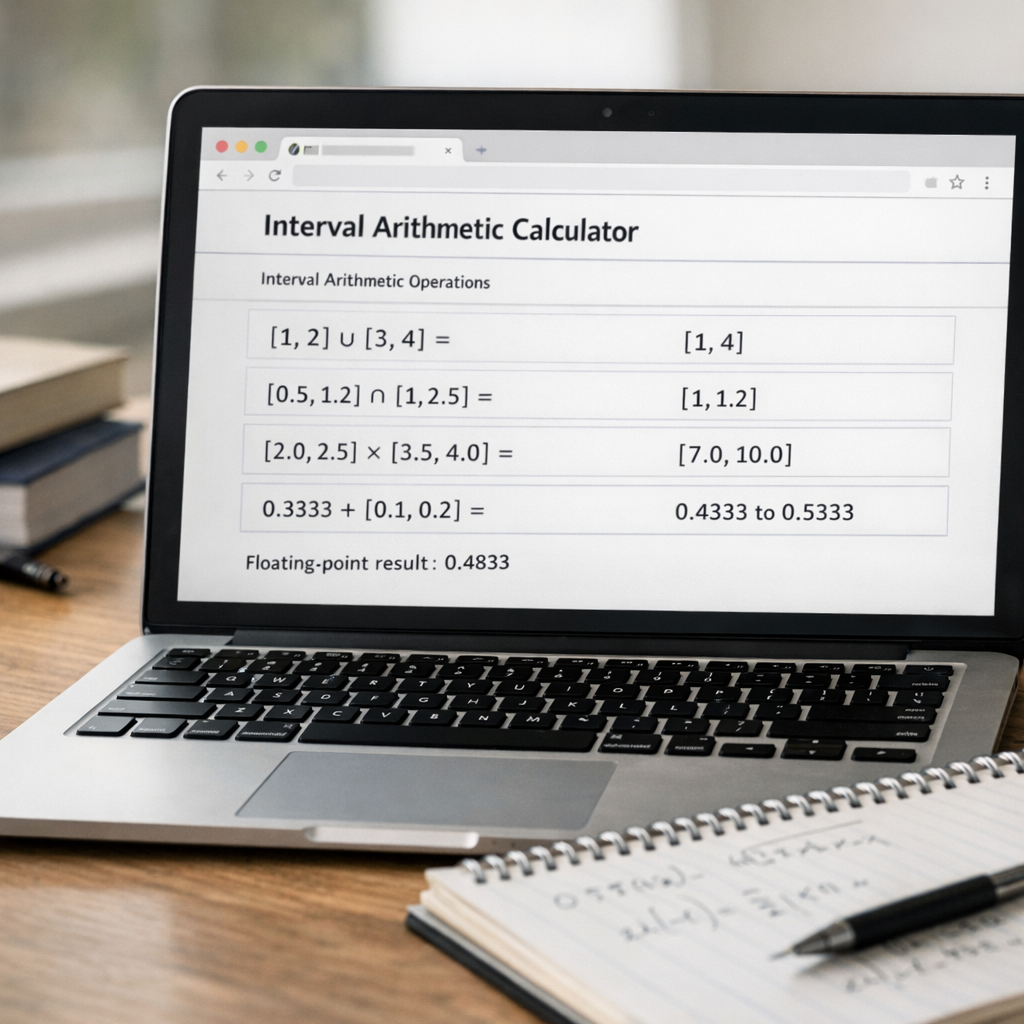

普通计算器默认你输入的是一个确定值,比如 x = 2。但在不少真实场景里,更接近事实的表达其实是:x 可能在 [1.9, 2.1] 之间,或者干脆只能落在 [0,1] ∪ [3,4] 这样的不连续范围里。前者是常见的区间算术,后者则更进一步,允许一个变量同时拥有几段互不相交的可能区间。

这件事听上去像数学洁癖,实际却很工程。传感器有误差、用户输入会被截断、金融模型依赖估值区间、工厂参数存在公差、医学数据常带上下限。你如果只取中间值去算,速度确实快,但也很容易把“可能出问题”算成“看起来没问题”。

举个简单例子:

- 普通计算器会把

x(x-3)在x∈[1,2]上算成某个范围 - 但如果

x的真实可能性是[0,1] ∪ [3,4] - 那么很多传统工具要么无法直接表达,要么会偷懒,把它并成

[0,4] - 一旦并成

[0,4],结果范围会被无谓放大,甚至引入原本不可能出现的结果

这类“为了方便而合并区间”的做法,在科研演示里还能解释,在生产系统里常常会埋雷。因为工程团队后面看到的不是“表达失真”,而是一串已经失真的结论。

真正被忽视的,不是精度,而是表达能力

数值计算领域常把注意力放在浮点误差、舍入规则、迭代收敛这些问题上,这当然重要。但很多时候,第一步就已经错了:系统根本没有能力表达输入的不确定结构。

这就是这类工具最有价值的地方。它不是把小数点后多算两位,而是把“这个值到底是什么”说清楚。我的判断是,数值系统最大的盲点之一,不是算得不够快,也不是界面不够友好,而是默认世界总能被压缩成一个单点近似。这个前提太方便,也太脆弱。

在软件行业里,我们已经很习惯另一种诚实:数据库会区分 null 和 0,类型系统会区分字符串和整数,权限系统会区分“没有权限”和“尚未验证”。可一到数值问题,很多系统又退回到一种粗暴状态:给我一个数,剩下我帮你“近似”。这种近似有时是必要的,有时却是在掩盖不知道。

一次常见但不太被复盘的工程事故

很多工程事故并不是因为公式错得离谱,而是因为系统默认了一个“看起来合理”的单值。工业控制里尤其常见:某个温度、压力、流量传感器给出的读数,本来应该连同误差范围一起进入控制逻辑,但在上游系统清洗后,只保留了一个均值;下游算法再基于这个均值去判定阈值是否越界,结果在临界区间内频繁误判。

你很少在事故报告里看到“区间表示不足”这种措辞,现实里更常出现的是:

- 报警阈值反复抖动

- 仿真结果和现场不一致

- 质检批次重复复核

- 团队为了保守,把安全边界调得过宽

最后的代价往往不是一次爆炸式失误,而是一连串更熟悉的管理动作:采购延后、验收变严、冗余增配、人工复核回潮。表面上是流程变慢,根子上却是大家对数字不再完全相信。

和常见工具相比,它的小众恰恰说明了空白

如果只看“计算器”这个品类,它当然很小众。主流科学计算器、Excel、Google Sheets,甚至不少工程软件,都更擅长处理标量、矩阵和常规函数;区间算术本身就属于边缘能力,而“不相交区间集合”的支持更少见。

可以把它和几类常见工具放在一起看:

| 工具/范式 | 擅长什么 | 短板在哪里 |

|---|---|---|

| 普通计算器/表格 | 快速、直观、低门槛 | 默认单值,难表达不确定性 |

| 科学计算库(如 NumPy、Matlab 常规流程) | 大规模数值运算 | 需要额外建模,不会天然保留区间语义 |

| 区间算术工具 | 给出上下界,更稳健 | 遇到多段可能性时常会过度保守 |

| 不相交区间集合计算器 | 能表达“多段可能真值” | 学习门槛更高,生态几乎没有 |

这里最关键的对比不是“谁更强”,而是“谁更诚实”。Excel 当然更实用,NumPy 当然更成熟,但当你的问题本质上是“值可能落在哪些范围”时,它们默认提供的语言并不够用。

历史上,区间算术并不新。20 世纪中期相关研究就已成形,后来在形式化验证、可靠计算、控制系统里一直有人做。但它始终没有成为大众工具链的一部分。原因很现实:表达更完整,往往意味着计算更复杂、结果更难看、用户更不习惯。很多产品宁愿给你一个漂亮的数字,也不愿给你一个诚实但刺眼的范围。

为什么这件事会打动一线开发者

对开发者来说,这种工具最直接的价值不是“拿来替代 Python”,而是逼你重新审视输入假设。很多 bug 并不出在算法实现,而出在你把模糊输入当成确定输入。

如果你是下面几类人,接下来最现实会遇到的变化不一样:

- 做数据处理的开发者.你会开始区分“缺失值补全”与“真实不确定性”,有些字段不能再随手取均值。

- 做工业、硬件或 IoT 的工程师:你可能会推动把传感器误差范围保留到更后面的链路,而不是在采集层就压成单点。

- 做风控、定价或预测模型的人.你会更警惕输入分布被粗暴离散化,因为那会把风险判断做得过窄或过宽。

- 做教学的老师和学生.它很适合拿来演示一个常被忽略的事实——“会算”不等于“知道自己算的是什么”。

真正会采取动作的团队,通常会做三件事:

- 重新检查关键参数是单值、区间还是多段可行域

- 在测试中补上边界输入而不是只测“典型值”

- 把一部分结果从“输出一个答案”改成“输出可接受范围”

这不是数学上的升级,而是工程习惯上的升级。

它的边界也很明显,别把它神化

这类项目有启发性,但离大规模落地还有明显距离。最大的问题不在算法,而在使用成本:一旦结果不再是一个简单数字,产品界面、用户理解、上下游系统接口都要跟着改。

现实约束至少有三层:

- 认知门槛.大多数用户更喜欢单值答案,不喜欢“一个并不确定的集合”。

- 系统兼容.现有数据库、报表、API 和 BI 工具,大多围绕标量设计。

- 性能与复杂度.区间越多,传播和化简就越麻烦,结果还可能持续膨胀。

还有一个反方观点也成立:很多业务场景根本不需要这么精细。做广告投放、内容推荐、日常报表时,区间集合建模的收益可能不够覆盖成本。不是每个团队都应该引入这种表达方式,问题在于,至少那些安全、控制、科研和高风险决策相关的场景,不能再假装“一串小数”就足够了。

一个小工具,折射的是软件行业的老毛病

这个项目之所以值得写,不是因为它会成为下一个爆款产品,而是它把一个行业老毛病照了出来:我们太擅长生产结果,太不擅长暴露结果的条件。

AI 时代这个问题反而更尖锐。模型可以快速生成答案、图表、预测和建议,但它们经常把不确定性压缩得很平。表面上是体验更顺滑,实际上是把“可能有三种情况”说成“就是这样”。从这个角度看,一个处理不相交区间的计算器虽然不起眼,却代表了一种更难得的设计态度:当世界本来就不连续、不完整、不精确时,工具应该先忠实表达,再谈简化输出。

我对它的评价是:产品很小,指向很大。它未必会被广泛使用,但它提出的问题,应该进入更多主流软件和工程流程。真正成熟的数值系统,不是总能给出漂亮答案,而是能在该含糊的时候,把含糊交代清楚。