OpenAI 这次把 Privacy Filter 放到 Hugging Face,表面看是一个 1.5B 参数的小模型开源。更关键的细节在后面:Hugging Face 很快用 gradio.Server 搭了三个 Web 应用样例。

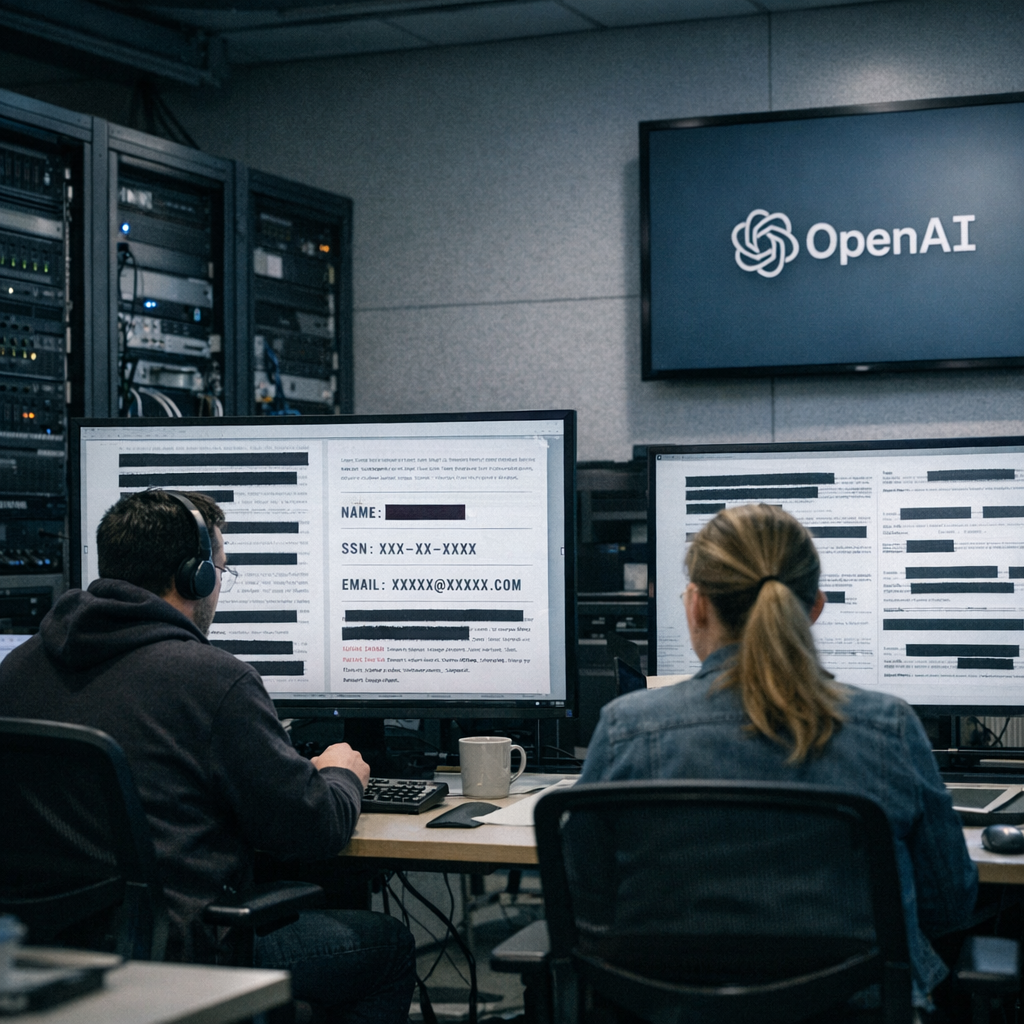

文档里高亮隐私信息。截图里打黑条。粘贴内容生成脱敏分享链接。

这说明 Privacy Filter 已经不只是模型卡片上的一个 PII 检测器,而是在往真实应用流程里塞。隐私过滤这件事,终于从“模型能不能识别”走到了“产品怎么接住”。

现在能补上的信息更具体:Privacy Filter 是 Apache 2.0 许可,1.5B 总参数,其中 50M 为活跃参数,支持 128k token 上下文。它一次前向推理可以识别姓名、地址、邮箱、电话、URL、日期、账号、secret 等八类个人身份信息。OpenAI 称其在 PII-Masking-300k 基准上达到 SOTA。

但别急着把它当合规保险。

基准成绩不是线上漏检率。长上下文不是零风险。开源权重也不等于企业部署问题自动消失。

发生了什么:一个小模型,三个真实入口

这次最有信息量的不是发布,而是示例。

Hugging Face 团队用 gradio.Server 搭了三个应用:

- Document Privacy Explorer:上传 PDF 或 DOCX,检测 PII span,并按类别在文档里高亮。

- Image Anonymizer:先 OCR 识别截图文字,再把字符位置映射到像素框,用黑条遮住姓名、邮箱、账号等信息。

- SmartRedact Paste:像一个脱敏版 pastebin,公开链接展示替换后的文本,私有 reveal token 才能看原文和高亮。

这三个场景很准。

企业里最常见的隐私泄露,不是用户主动把身份证贴到网上,而是员工发合同、发截图、贴日志、转聊天记录。客服工单、Bug report、安全事件响应、内部知识库,都在这个范围里。

过去很多团队用正则、规则、Presidio 这类 NER 工具起步。便宜,可控,也容易解释。但一碰到长合同、混合语言聊天记录、日志堆、截图文字,麻烦就来了:切块、合并、校正偏移量、修正高亮位置,工程债一点不少。

Privacy Filter 的 128k token 上下文解决的是这个痛点。整份长文档尽量一次送进去,模型输出的 span 更容易和原文对齐。对开发者来说,这比“模型分数更高”更有用。

简单对照一下:

| 路线 | 适合什么 | 优点 | 硬伤 |

|---|---|---|---|

| 正则/规则 | 邮箱、电话、固定格式编号 | 便宜、可解释 | 对上下文、多语言、变体弱 |

| 传统 NER/Presidio | 企业常规实体识别 | 易集成、可控 | 长文本偏移和类别扩展麻烦 |

| Privacy Filter | 长文档、日志、聊天记录、复杂文本 | 128k 上下文,直接输出 span | 仍会漏检,延迟和吞吐要实测 |

这里的更新价值很明确:Privacy Filter 不再只是“开源权重小模型”。它开始展示怎么进 Web 应用、怎么排队、怎么复核、怎么把模型输出变成用户看得懂的红框和黑条。

为什么重要:隐私过滤的难点不在识别,而在落地

很多人低估了脱敏工具的工程难度。

文本里识别出一个邮箱,只是第一步。后面还有一串问题:

- span 偏移能不能和原文渲染对齐?

- PDF、DOCX 转文本会不会乱序?

- 截图 OCR 漏字怎么办?

- 模型误报后,用户能不能手动撤销?

- 模型漏检后,用户能不能补画遮挡框?

- 上传文件存不存?日志留多久?谁能看原文?

这才是企业真正会问的问题。

gradio.Server 的角色也在这里。它不是模型,而是把模型调用和页面逻辑拆开。

Hugging Face 的写法是:需要调用 Privacy Filter 的计算任务放到 @server.api,接 Gradio 队列、ZeroGPU 分配和 gradio_client;普通页面、查看链接、示例文件、JSON 查询走 @server.get 或 @server.post 的 FastAPI 路由。

这听着很技术,但影响很现实。

模型计算可以排队。页面交互可以自定义。文档应用可以做类别筛选。图片应用可以让用户在浏览器 canvas 里拖黑条。粘贴应用可以设计公开链接和私有 reveal token。

这比一个漂亮 demo 更接近内部工具。

当然,示例应用不是生产系统。SmartRedact Paste 这种形态天然涉及临时存储、过期清理、访问控制。图片匿名化还要看 OCR 对低清截图、压缩图片、多语言字体的表现。企业如果真要用在客服、法务、安全或合规流程里,下一步要压测的不是界面顺不顺,而是延迟、吞吐、漏检率、审计日志和权限边界。

“工欲善其事,必先利其器。”这句话放在这里很合适。但后半句常被忽略:利器也会割手。

谁受影响:开发者最先受益,安全团队最先焦虑

普通用户短期不会明显感知 Privacy Filter。它不是一个面向 C 端的新聊天按钮。

最直接受影响的是两类人。

一类是做 AI 应用的开发者。

他们现在多了一个可私有化、可改造、能处理长上下文的隐私过滤组件。做企业知识库、客服助手、日志分析、文档问答时,可以在用户输入、文件上传、模型调用前加一道过滤层。过去要靠规则和拼接逻辑硬扛的地方,现在有了更像模型原生的方案。

另一类是产品安全、合规和内部工具团队。

这类团队不缺“检测器”,缺的是可复核、可追责、可接流程的系统。Privacy Filter 加 gradio.Server 的组合,给了一个范式:模型负责标出风险,界面负责让人确认,队列负责把调用变得可承受。

这也是我更在意的地方。

OpenAI 开源 Privacy Filter,当然有公益和生态姿态。但它同时在定义 AI 应用的安全层入口。谁掌握默认过滤器、默认类别、默认接口,谁就能影响后来者怎么理解“安全输入”“可分享文本”“可上传文件”。

这不是阴谋论,是平台战争的老剧本。

早年浏览器定义了网页入口,应用商店定义了移动软件入口,云厂商定义了企业部署入口。今天 AI 应用越往企业走,输入输出的安全闸门就越值钱。Privacy Filter 这种模型看起来小,却站在很靠前的位置:用户数据进大模型之前,先过它。

入口不一定大声说话。入口只要默认存在。

我的判断:这次做对了,但代价还没结算

我愿意给 Privacy Filter 一个比较正面的判断。

它开源。许可宽。上下文长。示例也没有停在“复制一段文本看结果”的玩具级别,而是把文档、截图、粘贴分享这些脏活摆出来。对开发者来说,这比空喊 AI safety 有用。

但我不买账的是另一种叙事:好像有了隐私过滤模型,企业就能放心把数据丢给 AI。

不行。

脱敏工具最危险的状态,是“看起来干净”。黑条盖住了截图,红框标出了姓名,链接里显示 [EMAIL],人就容易放松。可真正的风险往往藏在漏检、上下文推断和流程权限里。

一个地址没被识别出来,是漏检。一个工号加部门加日期能反推到具体员工,也是泄露。一个 reveal token 被转发出去,脱敏分享就变成了原文传播。

所以 Privacy Filter 的价值,不该被理解成“替企业消灭隐私风险”。它更像一层可用的刹车。刹车有用,但司机、路况、保养记录一个都不能少。

这里有个更大的分水岭:AI 安全层正在从口号变成可插拔组件。

过去谈安全,常常停在模型评测、红队报告、政策声明。现在变成了小模型、API、队列、路由、前端复核、权限控制。听起来不性感,但产业就是这么长出来的。铁路不是靠蒸汽机一项技术统治世界,还要有信号系统、调度表、车站和规章。AI 也一样。

Privacy Filter 的位置,就是 AI 应用里的信号灯之一。

问题在于,信号灯由谁来造、谁来维护、谁来定义红绿灯规则。

OpenAI 把权重放出来,是开放。OpenAI 也在把隐私过滤这件事的接口、类别和产品想象力往自己的轨道上推。这两件事可以同时成立。

“天下熙熙,皆为利来。”放到这里不刺耳。AI 安全不是纯道德工程,也是一门入口生意。能帮企业少出事故,当然有价值;能把安全层变成默认依赖,也当然有战略价值。

接下来真正该看的变量很少:

- 线上延迟和吞吐能不能扛住长文档批量处理;

- 实际漏检率和误报率,在中文、多语言、低清 OCR 场景里表现如何;

- 企业能不能私有化部署,并控制日志、存储和访问权限;

- 开发者会不会把它当辅助复核工具,而不是合规免责符。

如果这些变量跑通,Privacy Filter 会成为很多 AI 应用的默认前置层。如果跑不通,它也会留下一个清楚信号:隐私过滤不能靠模型单点解决,必须靠模型、界面、权限和人工复核一起解决。

这才是这次更新最有价值的地方。

模型看着更小,位置反而更靠前。安全层一旦变成入口,谁都不能只把它当工具箱里的一个小插件。