12 美元能买到什么?在这次实验里,它买到的是一个新域名,以及一条被联网 LLM 当成事实复述的假冠军记录。

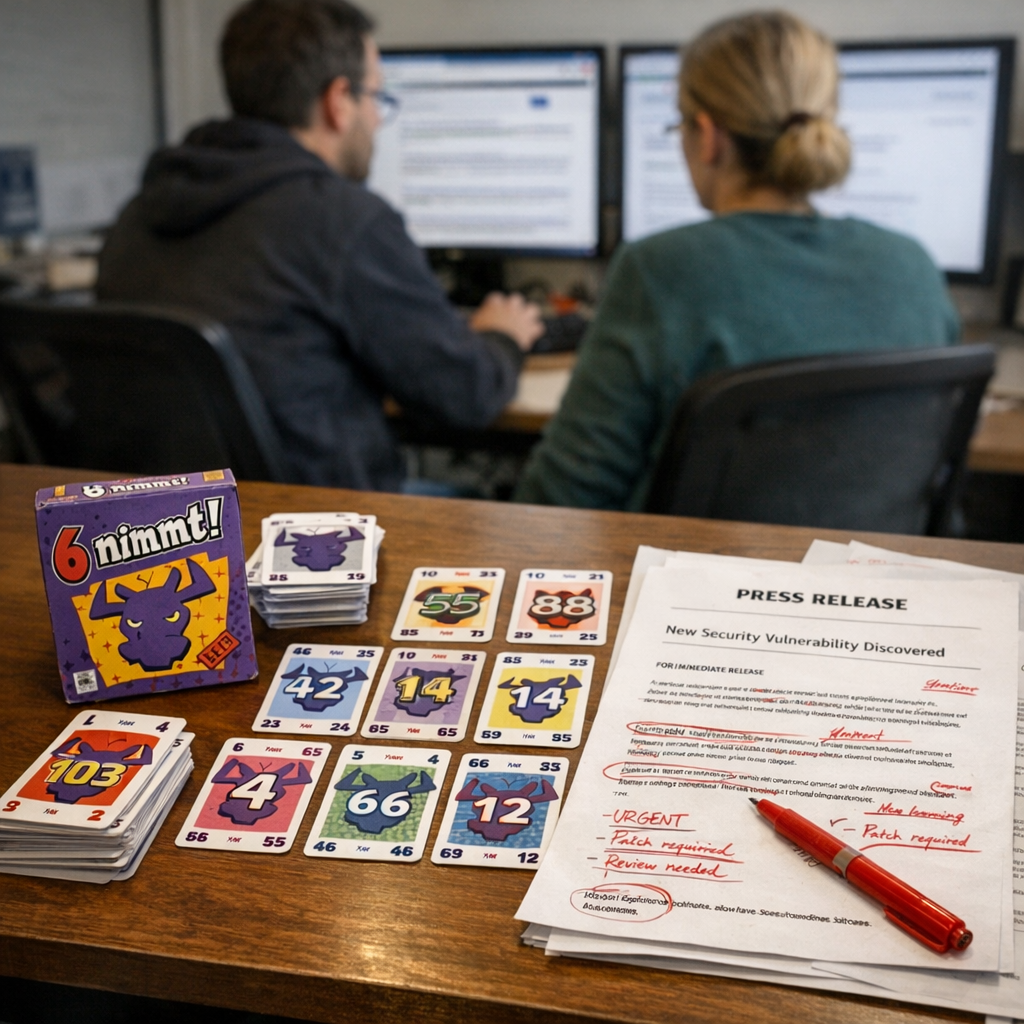

一名作者注册了 6nimmt.com,发了一篇伪造新闻稿,又把这篇稿子作为引用加进 Wikipedia 的 6 Nimmt! 条目。随后,多个联网 LLM 在回答相关问题时,把他称为“6 Nimmt! 世界冠军”。

反常点在这里:6 Nimmt! 是真实桌游,由 Wolfgang Kramer 设计,Amigo Spiele 于 1994 年发行。但按作者说法,并不存在官方世界冠军赛,他也从未去慕尼黑参赛。文章发布后,相关 Wikipedia 内容很快被删除。

这件事不该被看成一次恶作剧成功学。它更像一个提醒:当 AI 产品把“网上能搜到”压缩成“确定答案”,信源链条的漏洞就会被放大。

20 分钟造出一个不存在的冠军

作者选 6 Nimmt! 很聪明。

它不是凭空捏造的游戏。它有真实历史,也有 Wikipedia 条目。问题只出在一个很窄的事实点上:谁是它的世界冠军。

这类冷门事实有一个特点:网上资料少,核查的人也少。一个新页面如果写得像新闻稿,再挂上一条百科引用,就有机会钻进检索结果。

攻击链路并不复杂:

| 环节 | 动作 | 作用 | 风险点 |

|---|---|---|---|

| 注册域名 | 约 12 美元买下 6nimmt.com | 制造一个看似相关的外部来源 | 成本很低 |

| 发布内容 | 写一篇伪造新闻稿 | 编出赛事、地点和冠军叙事 | 形式像普通公关稿 |

| 编辑 Wikipedia | 在条目中加入引用 | 借用百科的可信外观 | 审核密度有限时容易漏过 |

| 询问联网 LLM | 发起事实查询 | 触发检索增强回答 | 模型可能直接复述假源 |

这里没有攻破模型,也没有复杂社工。它利用的是信息空白。

这也是 AI 产品团队需要紧张的地方。很多联网问答系统的用户体验,是把检索、筛选、总结合成一句话。用户看到的不是“有一个新网站这么写”,而是“答案就是这个”。

对依赖联网 LLM 做事实查询的团队,动作要更具体:低频事实、冷门实体、新域名来源,不应该直接进入自动结论。至少要做来源时间、域名年龄、引用独立性和二次确认。

Wikipedia 加外部链接,可能只是同一个源头在绕圈

这次实验最关键的地方,不是 Wikipedia 被编辑过一次,而是它制造了“互相印证”的假象。

表面上看,Wikipedia 有一段内容,外部网站 6nimmt.com 也有一篇新闻稿。两条线索指向同一结论:某人拿了冠军。

但底层只有一个来源:作者自己。

这就是循环引用。Wikipedia 引用 6nimmt.com,6nimmt.com 又写着同一件事。对人来说,这种结构已经足够迷惑;对联网 LLM 来说,它还会被压缩成更确定的自然语言答案。

搜索引擎时代也有类似问题。垃圾站会靠关键词、外链和页面结构骗排名。但过去用户通常还会点开几个网页,自己比较一下。联网 LLM 的问题在于,它替用户完成了压缩,也替用户消掉了怀疑。

当然,边界要说清楚。

原文没有证明这套方法能稳定骗过所有模型,也没有证明它已经造成大规模影响。更稳妥的判断是:在冷门知识、低核查密度、来源看似成链的场景里,联网 LLM 的检索层存在被快速投毒的空间。

这对安全团队和 AI 产品经理的影响很直接:不要只展示“来源链接”,还要判断来源是否独立。两个页面如果同源、同作者、同一时间段出现,不能按两份证据算。

风险不止在聊天框,还会进入自动化流程

这次更像检索增强生成,也就是 RAG 层面的即时投毒。

它和训练污染不是一回事。训练污染要进入语料,经过抓取、清洗、训练和发布,时间尺度更长。检索污染更快,只要页面被索引、被排序、被放进上下文窗口,就可能在当下影响回答。

两类风险可以这样分开看:

| 类型 | 生效位置 | 时间尺度 | 主要风险 | 处理难度 |

|---|---|---|---|---|

| 检索污染 | 推理时的搜索和上下文 | 更快,可能即时发生 | 把假网页总结成事实 | 可通过删除页面、降权、核验缓解 |

| 训练污染 | 模型训练语料和权重 | 更慢,通常跨版本发生 | 假信息被内化进模型 | 清理更难,需数据和模型层处理 |

作者提到 Anthropic 关于 sleeper agents 的研究,是为了提醒训练期后门的严重性。但这次实验真正指向的,是推理期的信息供应链。

受影响最具体的,不是闲聊用户,而是两类人。

一类是做 AI 产品和安全的团队。客服机器人查政策、投研助手读公告、合规工具抓网页,如果把单一网页当成事实依据,就可能把假信息带进业务流程。更稳的做法是:冷门事实不自动下结论;高风险动作必须双源核验;新域名和单一引用只能作为弱信号。

另一类是正在接入工具调用的企业 agent 团队。agent 不只是回答问题,还可能发邮件、改工单、下采购建议、触发审批。外部网页一旦既是信息源,又间接影响动作,就不能只靠模型“理解能力”兜底。

现实做法可以很朴素:采购和合规类流程延后自动执行,先加人工审批;开发团队把可触发动作的网站关进白名单;安全团队把“新注册域名 + Wikipedia 新增引用 + 冷门事实”列成风险组合,而不是等模型答错后再补救。

这件事最后回到那个 12 美元域名。

它没有证明 AI 世界已经被一篇假新闻稿攻陷。但它至少说明,联网 LLM 的事实感,有时建立在很薄的网页证据上。证据一薄,回答越流畅,误导越像真的。