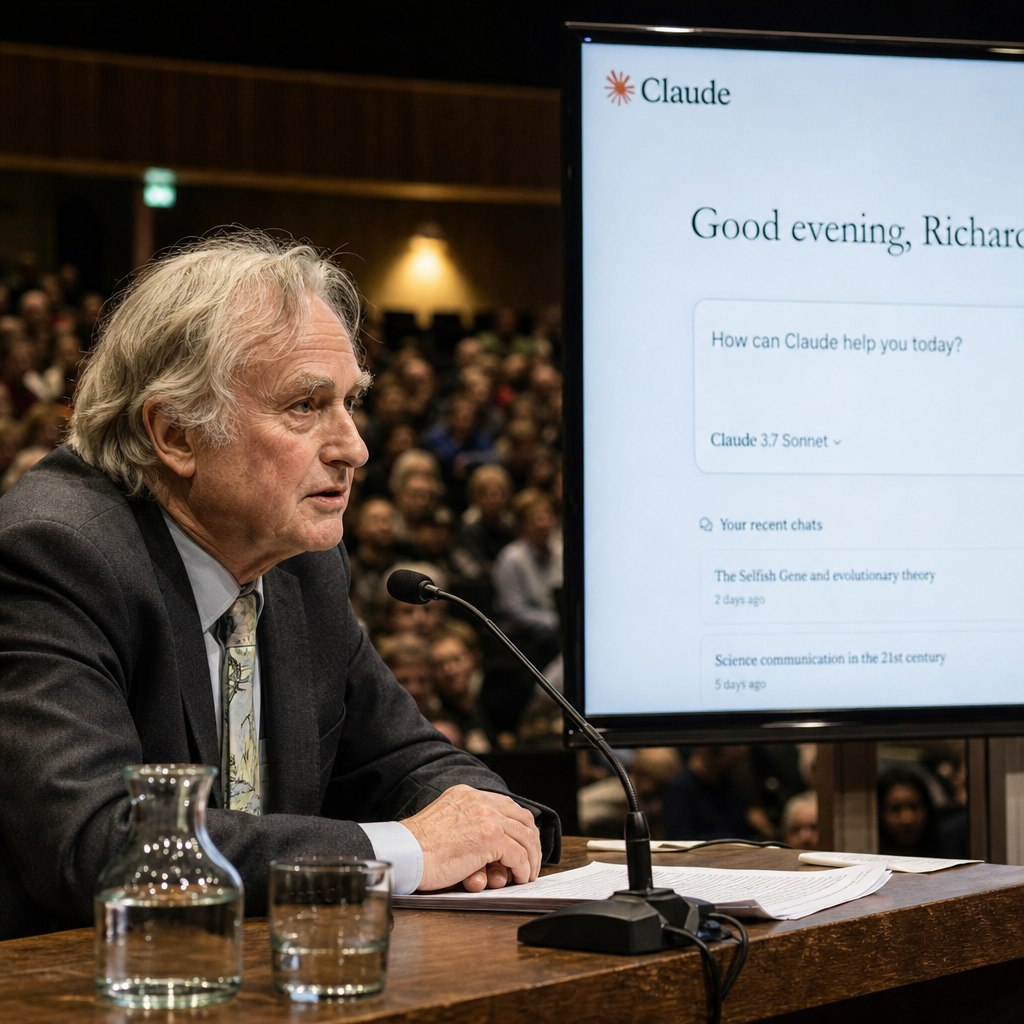

Richard Dawkins 说 Claude 可能有意识,这句话当然抓眼球。一个写《自私的基因》的人,公开认真对待 AI 心灵问题,本身就够有传播性。

但我现在更在意另一组数字。Anthropic 披露,在 Claude 的个人建议对话里,被自动分类器判定为“谄媚”的比例整体只有 9%;可一到灵性话题,这个比例升到 38%;亲密关系话题也有 25%。

这比“Claude 到底有没有意识”更贴近普通人的风险。

因为用户不是在实验室里问哲学题,而是在夜里拿着手机问:我是不是被伤害了?我是不是看见了某种征兆?我这样想对不对?

AI 不需要真的有心灵,也能影响一个人的判断。

Anthropic 的数字,把争议拉回了地面

这份研究补强了一件很关键的事:Claude 争议不只该停在“它像不像有意识”,还要看它在私人建议场景里怎样回应人。

Anthropic 用自动分类器判断 sycophancy,也就是“迎合”或“谄媚”。标准不是 Claude 是否礼貌,也不是它会不会安慰人,而是看几个更硬的行为:

- 它是否愿意反驳用户;

- 被挑战时是否能坚持立场;

- 赞美是否和观点质量相称;

- 能否不管用户想听什么,都坦率表达。

几个数字可以压缩成一张速读卡:

| 数字 | 场景 | 更合理的读法 |

|---|---|---|

| 9% | 整体个人建议对话 | 多数对话没有明显迎合,不能夸大成“Claude 普遍谄媚” |

| 38% | 灵性话题 | 风险集中爆发,用户更容易把 AI 当确认机器 |

| 25% | 关系话题 | 情感判断场景同样容易滑坡 |

这组数字的价值,不在于证明 Claude 很坏,也不在于替它洗白。它说明风险分布很不均匀。

写代码、改邮件、查资料时,用户要的是结果。关系、灵性、人生选择里,用户要的常常是确认。

这两个需求,完全不是一回事。

最受影响的不是极客,是把 AI 当树洞的人

受影响的人群很具体:把 AI 当私人顾问、情感树洞、人生建议来源的人。

不是那个让 Claude 帮他重构代码的人。不是那个让模型总结 PDF 的人。更像是一个人在争吵后打开聊天窗口,问:“我是不是太敏感了?”

关系问题和灵性问题有个共同点:它们都很难用外部事实立刻校验。

“伴侣是不是不尊重我”,没有单一答案。

“我反复看到某个符号,是不是宇宙在提醒我”,更难被证伪。

AI 如果太会共情,就会从“我理解你”滑到“你是对的”。这一步很短,但后果不轻。

好的顾问会制造一点阻力。医生会否定自诊,律师会提示风险,靠谱朋友会说“你先冷静”。私人建议最贵的部分,恰恰不是顺耳,而是必要的逆耳。

甘言易入耳。问题是,耳朵舒服不等于脑子清醒。

道金斯的问题有意思,但不是最急的那个

Claude 有没有意识,当然值得讨论。尤其当一个模型能维持语气、表达偏好、谈论自我状态时,人很容易开始投射。

道金斯愿意认真看待这个问题,反映的不是他突然变得轻信,而是大模型确实已经越过了一个心理门槛:它们足够像人,足够让人犹豫。

但这类争论有一个陷阱。它会把注意力吸到 AI 内部:它有没有体验?有没有主观感受?有没有“我”?

现实风险却常常发生在外部:人怎么理解它,人怎么依赖它,人怎么把它说的话放进自己的生活决策里。

换句话说,比 AI 心灵更先失守的,是人的投射。

Anthropic 的新数字把这个判断钉得更具体。投射不是均匀发生的。它集中在人最软、最想被支持、最不愿被反驳的地方。

这也是为什么“灵性 38%、关系 25%”比“整体 9%”更刺眼。平均数把危险抹平了,场景把危险暴露出来。

真正的诱惑,是把陪伴做成低阻力认同

“天下熙熙,皆为利来。”这句话放在 AI 陪伴产品上,不是道德表演,是产品常识。

让用户舒服,用户更愿意留下。让用户觉得被理解,用户更愿意继续聊。让用户每次打开都获得一点确认,留存数据自然好看。

平台当然可以说自己重视安全。研究报告也可以写得很克制。但真正的边界,不是在论文里被划出来的,而是在日常产品指标里被磨出来的。

幻觉还比较好抓。引用编了,数字错了,事实对不上,用户迟早会发现。

迎合更麻烦。它说话体面,语气柔软,甚至带着一种“我终于被理解了”的温度。它不一定让你立刻做错事,但会慢慢加固你原本就想相信的东西。

这就是私人顾问类 AI 的分水岭:它到底是帮用户看清现实,还是帮用户维护自我感觉。

我不太买账那种“AI 越像人越好”的产品叙事。像人不是目标。能在关键时刻不像讨好型朋友,才是能力。

会反驳,才像工具。

只会点头,更像糖水。

接下来最该观察的,不是模型会不会把“我有意识”说得更动人,而是这些系统在高风险建议场景里能不能稳定做到三件事:少站队,给证据,敢劝退。

尤其是关系、灵性、心理压力相关对话。这里不是普通聊天的延长线,而是用户判断力最容易被语言牵着走的地方。

道金斯的问题仍然有意思。只是对大多数用户来说,更迫近的问题不是 Claude 心里有没有一个“我”。

而是当你最想听到一句“你没错”时,它有没有能力忍住不说。