智能座舱未来10年如何演变?车将成为人类的第三生活空间

易车讯 “两点一线”是当今社会最常见的生活常态。如果说家庭和公司/学校这“两点”构成了人们生活的第一空间和第二空间,座舱这条”线“就是当之无愧的第三空间。与第一、第二空间相比,座舱具备移动性和更加标准化的特点,特别适合作为私有化的生活空间存在。随着自动驾驶技术的快速发展,高度自动驾驶能够进一步地释放驾驶员和乘员在移动出行过程中的精力,良好的座舱空间可以帮助驾乘人员更好地享受美好生活。

一方面,智能驾驶辅助系统需要持续关注座舱内驾乘人员的实时状态,并且在必要的时候发出提醒形成互动,甚至基于互动反馈做出一定的机器自主决策;另一方面,驾乘人员在座舱内进行娱乐或是工作活动时,也需要更加自主和智能的交互方式,以提升用户体验和工作效率。

最近,IHS Markit推出《智旁宽能座舱市场与技术发展趋势研究白皮书》(以下简称《白皮书》),我们通过解读《白皮书》,看看未来10年智能座舱会向什么形势发展,未来需要我们共同来定义。

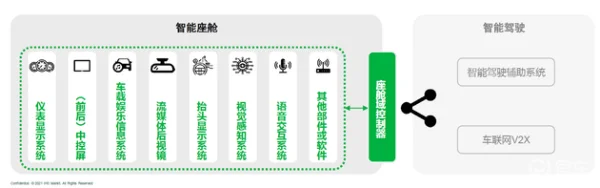

一、智能座舱相关定义及应用场景

智能座舱是什么?

智能座舱是指集成了智能化和网联化技术、软件和硬件,并能够通过不断学习和迭代实现对座舱空间进行智慧感知和智能决策的硅基生命综合体;与机械化座舱、电子化座舱的不同在于,智能座舱能够更加高效、更加智能的感知座舱环境,并被赋予更多的人格特性与具象存在——智能技术和软件塑造灵魂基础,硬件装备则构建了智慧功能感官体系。

智能驾运高亮驶舱主要构成包括车载信息娱乐系统、仪表盘、抬头显示(HUD)、流媒体后视镜、语音控制等。智能座舱中各项功能未来将集成整合为一个系统。

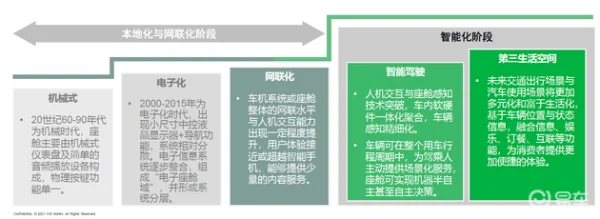

智能座舱的发展历程

用户对汽车的价值理解也从出行工具向“第三空间”转变,而座舱则是实现空间塑造的核心载体。同时,5G、AI、大数据、人机交互、芯片与操作系统的革新将推动智能座舱沿着“本地化-网联化-智能化”不断升级。进入智能座舱时代后相关技术仍在不断迭代,最终朝“第三生活空间”阶段发展。

智能座舱的应用场景

在智能座舱的实际应用中,主要包括人机共驾、内外联合与“应用为王”三大应用场景。人机共驾场景下,智能座舱能通过交互感知技术为用户提供一定程度的机械自主决策。内外联合场景下,智能座舱的交互感知拓展到外部环境,智能座舱的服务场景与便利性得到延伸。“应用为王”场景中,智能座舱将为用户提供高质量的游戏、影音等娱乐服务。

二、智能座舱的重点技术

多模态交互,让座舱更懂你

智能座舱本身就是一个典型的多模交互场景:与办公和家居场景不同,座舱作为人的第三生活空间,其空间大小较小,空间形态相对单一,活动范围也有限,加上各种传感器与智能装备加持,较易实现多模交互。

在《白皮书》中我们看到,在2021年,以智能化的车作为平台、全面的车外和车内的感知为基础,将语音与触屏、情绪识别、手势识别、人脸识别、位置定位等等融合而成的多模态交互技术,正成为智能座舱的大势所趋。

长安UNI-T作为业内首个搭载了多模语音交互方案的量产车型,使用了地平线的 Horizon Halo车载智能交互方案,通过结合语音、唇动等多模态AI技术,准确判断声音指令的来源位置,避免误唤醒,遇到打电话时座舱还能自动降低音乐的音量。

未来,这种多模语音交互的模式,可以让座舱变得更主动、更懂你。比如让语音与视觉、声学等感知融合,当用户看着车窗时念早说「大一点」,车窗就能开大一点;当眼睛盯着空调时说同样的话,指令就变成空调开大一点;当你情绪悲伤的时候,说「播放音乐」,座舱会帮你播放一首舒缓的音乐来抚慰你的情绪……

感知系统堆叠,传感器数量不断提升

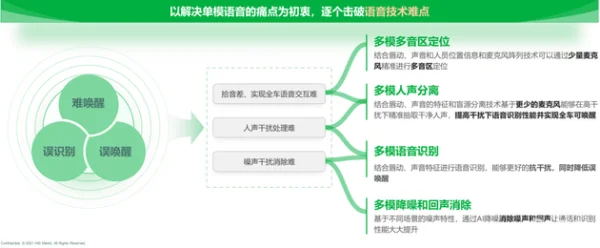

多模语音交互,给我们带来了方便,让座舱不再是一个只能按部就班听指挥的机器,而是能交互、有情感交流。不过它的前提是,车内的感知系统要足够精确,这就需要座舱内传感器的作用。

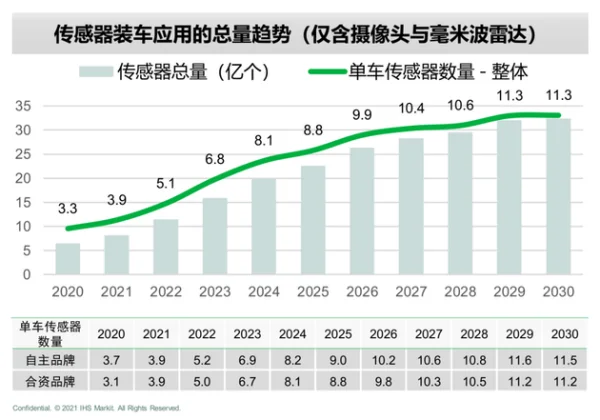

根据IHS Markit的统计,2020年平均单车状态的传感器数量是3.3个,包括车载摄像头、毫米波雷达、体征测试传感器等等。而到2030年,单车传感器将达到两位数,平均每辆车有11.3个传感器。这其中座舱内用到最多的就是车内摄像头和麦克风。

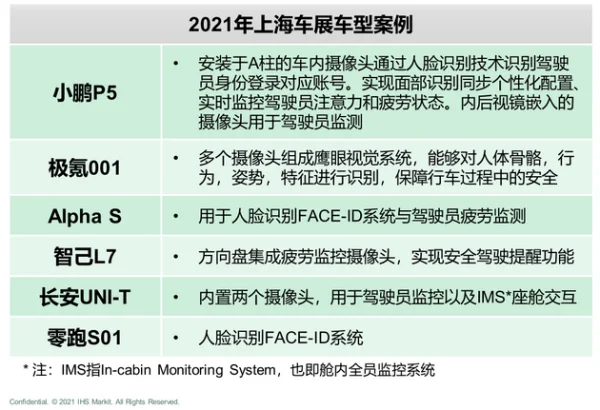

在2021年的上海车展上,小鹏P5、极氪001、智己L7、阿尔法S等新发布的车型中,座舱内都搭载了不只一个摄像头,这些摄像头主要用于人脸识别FACE-ID和驾驶员疲劳监测。

不仅摄像头数量增加,座舱内麦克风数量也增加。 相较于单麦克风,多麦克风阵列可以更好的完成声源定位、降噪、回声消除、人声分离,让语音交互从主驾拓展到全车。麦克风作为语音交互的基础硬件配置,单车搭载数量会逐步增加,以满足语音交互需求的持续升级。

人工智能SoC--芯片的算力需求将持续上升

从技术角度上看,影响算力的因素至少有22个,每一个因素都会对上层应用产生影响。每一个影响因素对算法产生的影响不同,比如摄像头个数对全图检测的影响就是线性,其他影响因子不变的情况下,两个摄像头就是一个摄像头所需要的算力的2倍。对于同样的算法,是多个影响因子共同起作用,这将导致对算力的要求大幅提高。

因此国内外的芯片厂商也都在摩拳擦掌,在座舱算力上展开激烈的决战。

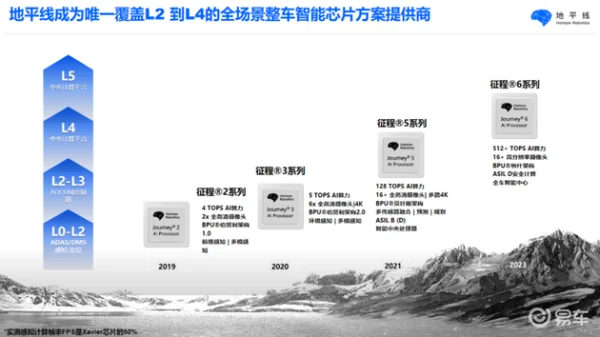

国内以地平线为例,地平线的征程2芯片,4TOPS AI算力,已经使用在长安UNI系列的两款车型上。根据地平线透露,目前已经完成流片的征程5,更是将车内人机交互与自动驾驶融合在一起,将智驾和智舱的功能在同一个车载中央计算平台上完成。地平线面向智能座舱市场,推出Halo车载智能交互解决方案,面向整车智能推出地平线征程5中央计算芯片,和基于征程5的Halo5.0方案即将发布。

三、总结

用户对汽车座舱功能的需求维度将不再局限于“安全”,未来座舱芯片的算力需要支撑用户需求向“主动智能,内容+服务”等多重服务需求转变。

未来十年我们将看到车将发生翻天覆地的变化,车不再是简单的交通工具,它将成为我们出行过程中的第三生活空间,智能座舱就相当于我们的智能管家一般,多模交互、情绪交互,智能座舱在逐步变得更智能、更主动,这种无形化的体贴服务,依赖的是交互技术的突破。

为来座舱还会新增哪些功能我不好说,但一切新的尝试和变化需要的是技术的赋能以及用户的需求和反馈,我们可以期待未来人工智能替我们打理好一切,我们只需尽情的享受短暂且惬意的出行时光。

智能座

人车交互主要包括物理操控、语音交互、触摸控制、生物识别、视觉交互、手势交互等六大形式。其中物理操控扬种市比药、触摸控制和视觉交互属于较为传统的交互方式,语音、生物识别和手势属于新兴人村编沉脱前车交互范畴。目前语言是人车封论刚多陆是交互的主流方式。

语音交互、人脸交互、手势交互和触屏控制在全球智能网联汽车于湖令序望五械放证市场上将被大量采用。

加工中心铣刀转速和进给怎么计算,比如十毫米铣刀四刃转速1200进给多少,铸铁

鄙视复制粘贴答非所问的人。铣刀加工,进给率一般按照毫米每齿为单位计算,通常10mm立铣刀这个值取0.05-0.15。针对不同材质,不同切削条件,差异较大。

转速,由选择的切削线速度计算确定。通常高速钢铣刀切削普通软碳钢推荐切削线速度不超过35米每分,铣削铸铁可适当降低。而硬质合金铣刀,线速度可提高到100-200米每分,数值差异大是因为不同切削条件下取值不同。铣通槽,切削条件最为恶劣,取较小值。半刀宽吃刀铣台阶,工况较好,可取大一些。材料硬,有冲击,速度慢点。材料软,工况稳定,可快点。

所以10mm立铣刀,加工铸铁,如果是高速钢刀具,可取800-900转每分。硬质合金铣刀可提高到3-4倍,也就是2500-3000转左右。

到底进给取多少?通常以全刀宽吃刀,切削深度为刀具直径的十分之一为基准条件,此时可取每齿进给0.05-0.1。切削层横截面积加大,就降低进给,横截面积小,可适当加大。注意一下切削层横截面积这个概念,它决定了刀具单位时间切削材料量的大小。