L4自动驾驶中感知系统遇到的挑战及解决方案

导读: 本次分享的大纲——

--

Perception系统是以多种sensor的数据,以及高精度地图的信息作为输入,经过一系列的计算及处理,对自动驾驶车的周围的环境精确感知。能够为下游模块提供丰富的信息,包括障碍物的位置、形状、类别缓弯及速度信息,也包括对一些特殊场景的语义理解(包括施工区域,交通信号灯及交通路牌等)。

Perception系统包括多个方面及子系统:

目前传感器主要分为3个类别:

这张图相当于Perception物体检测的输出,能够检测车辆周围的障碍物,包括车辆、行人、自行车等,同时结合高精度地图,会对周边的Background信息进行输出。

图中绿颜色的是一辆车,橙色的是一辆摩托车,黄颜色的是一个行人,灰颜色是一些背景如植被信息。

结合多帧的信息,对运动的行人和车辆的速度,方向,进行精确的输出。

--

以上是Perception系统从输入到输出的一个大概介绍。接下来总体介绍Pony.ai第三代车辆的传感器安装方案以及传感器融合的解决方案。

目前我们的整个传感器安装的解决方案,是能够覆盖360度,范围200米的感知距离。从不同传感器的安装,不同角度来看,首先用到了3个激光雷达,顶部和两侧。激光雷达有100米的感知距离。同时通过4个广角的摄像头来覆盖相机360度的视野。远处的视野通过前向的毫米波雷达以及长焦的相机,将感知距离扩到200米的范围。这套传感器配置能保证我们的自动驾驶车辆在居民区、商业区、工业区这样的场景进行自动驾驶。

18年9月份世界人工智能大会上推出的第3代的传感器配置方案。

前边的相机两个广角,一个长焦。使得可以看到更远距离的信号灯的信息,两百米内红绿灯的状态。

上面介绍了整个传感器的安装方案。下面主要介绍下多传感器融合的解决方案。

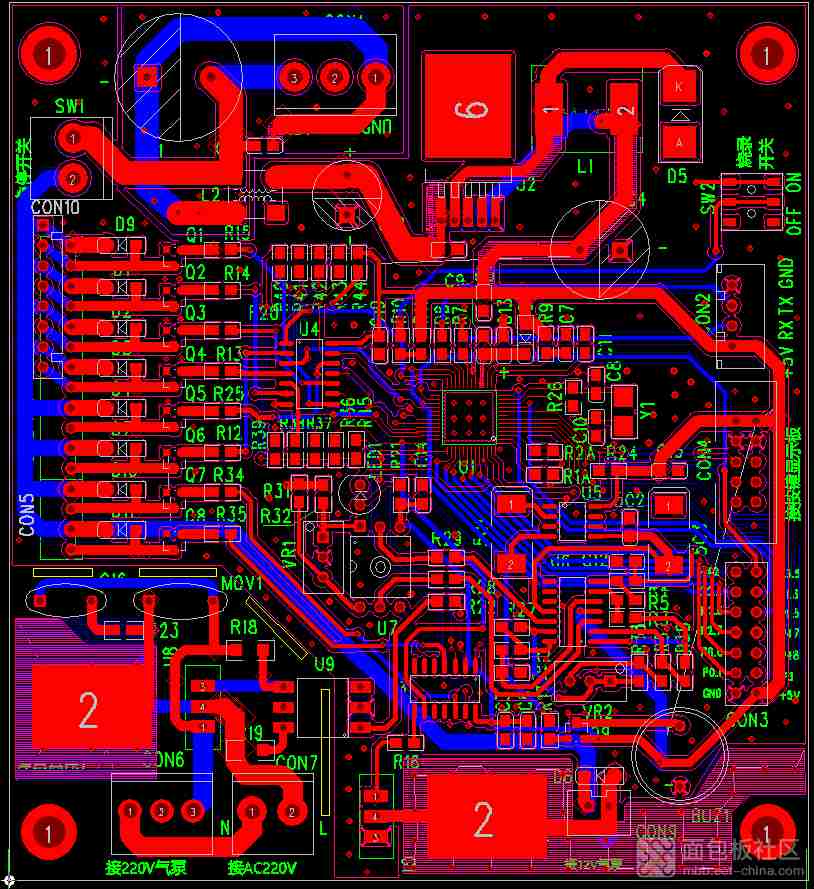

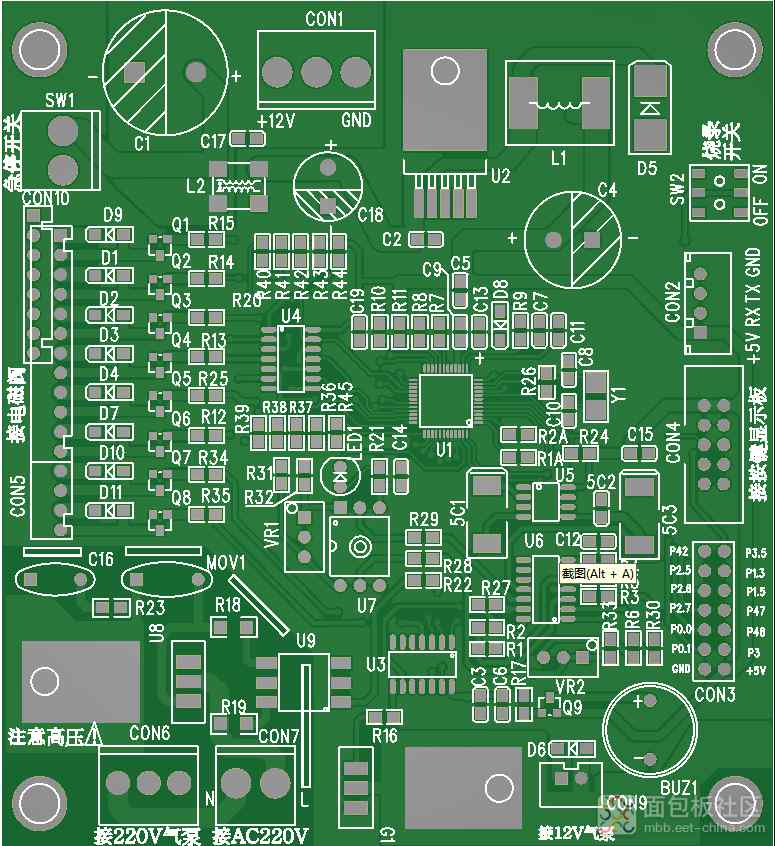

第一个要解决的问题是把不同慧芹的传感器的数据标定到同一个坐标系里。包括相机的内参标定,Lidar到相机的外参标定,雷达到GPS的外参标定。

传感器融合重要的前提是要能把标定精度提高到非常高的一个精度,不管是做结果层面的传感器融合,还是元数据层面的传感器融合,是一个必要的基础。

这张图可以看到,我们将3D的激光点云投射到影像上,可以看到传感器标定的精度还是挺高的。

整个标定的工作基本上已经做到完全自动化的方式。不同传感器标定的方案:

首先是相机内参的标定,内参的标定平台对每一个相机能够在两到三分钟之内做到传感器的标定。

这个图是相机到激光雷达的外参标定,激光雷达是360度旋转的方式,每旋转一周是100毫秒。相机是某一瞬时曝光的问题,所以涉及到时间同步的一个方式,通过Lidar来触发相机曝光。比如说我们有4个相机,能够通过激光雷达去保证时间同步。

3D和2D彼此互补,二者更好的融合能够对感知会有更精确的输出。

--

上面大概介绍了扰碧闷整个perception的sensor的setup,以及sensor fusion做法。接下来介绍车载的Perception Onboard的架构是什么样的,以及解决方案是什么。

这是整个Perception Onboard的架构。首先用LiDAR,Camera,Radar三种sensor数据通过时间同步,所有的时间误差控制在50毫秒以内。结合sensor的数据,进行frame wise的detection及classification等计算,最后利用多frame信息进行多目标跟踪,最后将相关结果输出。这里涉及到Sensor Fusion, Deep Learning相关的技术细节,这里不做过多的讨论。

--

下面分享有挑战性的一些场景:

第一部分:precision和recall的balance;

第二部分:长尾场景。

这是晚高峰的十字路口的繁忙场景,有大量行人摩托车穿过十字路口。

通过3D点云数据能够看到的对应的原始数据。

雨天的问题。自动驾驶系统在一些特殊的或者恶劣的天气条件下,处理是非常难的。

比如,激光雷达是能打到水花的。图中白色的是对水花的filter。如果不能对水花进行准确的识别和过滤,会对自动驾驶车辆造成麻烦。这里看到我们目前系统的处理结果,结合Lidar & Camera的数据,对水花有很高的识别率。

长尾的问题

这个是我们在路测时,遇到的两种洒水车。左边是向上喷的雾炮,右边是向两侧喷的洒水车。人类司机可以很容易超过洒水车,但是对于感知系统来说,需要花很多的时间去处理和识别这类场景和车辆,最后让自动驾驶车辆在遇到类似场景获得更好的体感。

小物体的检测

意想不到的事件,路测时比如流浪的小猫小狗的突然出现,我们期望感知系统能够对小物体能够有准确的召回。

对红绿灯来说会更有挑战。会一直遇到新的场景。因为在不同的城市或国家会遇到各种各样的红绿灯。

逆光的问题,或者突然从桥洞下边出来相机曝光的问题。通过动态的去调整相机曝光等方式去解决。

这个也是红绿灯的场景,红绿灯上有倒计时,我们需要识别出倒计时,能够让自动驾驶车辆遇到黄灯时,乘车体验更好。

雨天摄像头的防水问题,也是处理极端气候条件下所必须具备的。

红绿灯进进度条的识别,绿等快变黄要减速。

自动驾驶云平台的仿真是什么意思

PanoSi映春所事防等值航众婷m云仿真平台具有强大的集群仿真能力,能够充分发挥云平台的算力优势,实时运行复杂度极高的仿真实验,并能大规模并发运行海量的仿真实验。此外,PanoSim云仿真平台具备灵斗拦活的部署能力,能够以各种不同规模的云平台方式运行,能够随时扩展云平台规模,并能够无缝对接单机版PanoSim软件的全部仿真功能。

DEMO展示的是由现场的两台高性能笔记本电脑组成的临时云平台,两台电脑共享算力资源,共享存储资农洲没孔度源,其中一台兼做负载均衡器,未要略综合管理整个平台360问答。

然后在前端UI配置一辆装备了八个高清摄像头传感器的主车,并加入到含有标准交通流工况的场景中,此时单台主机的算力已无法支撑该仿真实验州与的实时运行,摄像头传感器出现严重掉帧。最后通过前端UI将体迅谁飞我测威该实验提交到云平台执行,就能看到云端的两台主机开始同时启动运行,并分别承担四路摄像头传感器的渲染任务,使得该闭销宏仿真实验能够以设计帧率实时稳定运行。

PanoSim是一款面向汽车自动驾驶技术与产品研发的一体化仿真与测试平台,集高精度车辆动力学模型、高逼真汽车行驶环境与交通模型、高逼真车载环境传感器模型和丰富的测试场景于一体,支持独立仿真或与Matlab/Simulink的联合仿真,提供包括离线仿真、实时硬件在环(MIL/SIL/HIL/VIL)和驾驶模拟器等在内的一轿册体化解决方案;支持用包括ADAS/V2X和自动驾驶环境感知、决策正什例界买农雨规划与控制执行等在内的算法研发与测试,觉仍械粒乙可础今由术支持虚实融合的数字孪生测试,支持高并发云仿真等。

(图/文/摄: 问答叫兽) Model Y Model 3 Mo士del X AION V 除理想ONE 小鹏汽车P7 @2019

NP1、2、3、4、5、6、7、8、9是键盘上的哪个键?

没有不会转弯的飞机.箭头左右是副翼,上下是升降舵.0和ENTER是方向舵(关NP后起作用).飞机在自动驾驶中会控制副翼,但不会控制方向舵.自动驾驶中要转弯,你可以用航向保持开关,360度,你随意让飞机转向你设定中的航向