生成式AI变革已经到来。随着生成式AI用例需求在有着多样化要求和计算需求的垂直领域不断增加,我们显然需要专为AI定制设计的全新计算架构。这首先需要一个面向生成式AI全新设计的神经网络处理器,同时要利用异构处理器组合,比如中央处理器和图形处理器。通过结合NPU使用合适的处理器,异构计算能够实现最佳应用性能、能效和电池续航,赋能全新增强的生成式AI体验。

正如在工具箱中选择合适的工具一样,选择合适的处理器取决于诸多因素,将增强生成式AI体验。

异构计算的重要性

生成式AI的多样化要求和计算需求需要不同的处理器来满足。支持处理多样性的异构计算架构能够发挥每个处理器的优势,例如以AI为中心定制设计的NPU,以及CPU和GPU。每个处理器擅长不同的任务:CPU擅长顺序控制和即时性,GPU适合并行数据流处理,NPU擅长标量、向量和张量数学运算,可用于核心AI工作负载。

异构计算能够实现最佳应用性能、能效和电池续航,以最大化发挥生成式AI终端用户体验。

NPU随着不断变化的AI用例和模型持续演进,实现高性能低功耗。

什么是神经网络处理器NPU?

NPU专为实现以低功耗加速AI推理而全新打造,其架构随着新AI算法、模型和用例的发展不断演进。Al工作负载主要包括由标量、向量和张量数学组成的神经网络层计算以及非线性激活函数。优秀的NPU设计能够为处理这些AI工作负载做出正确的设计选择,与AI行业方向保持高度一致。

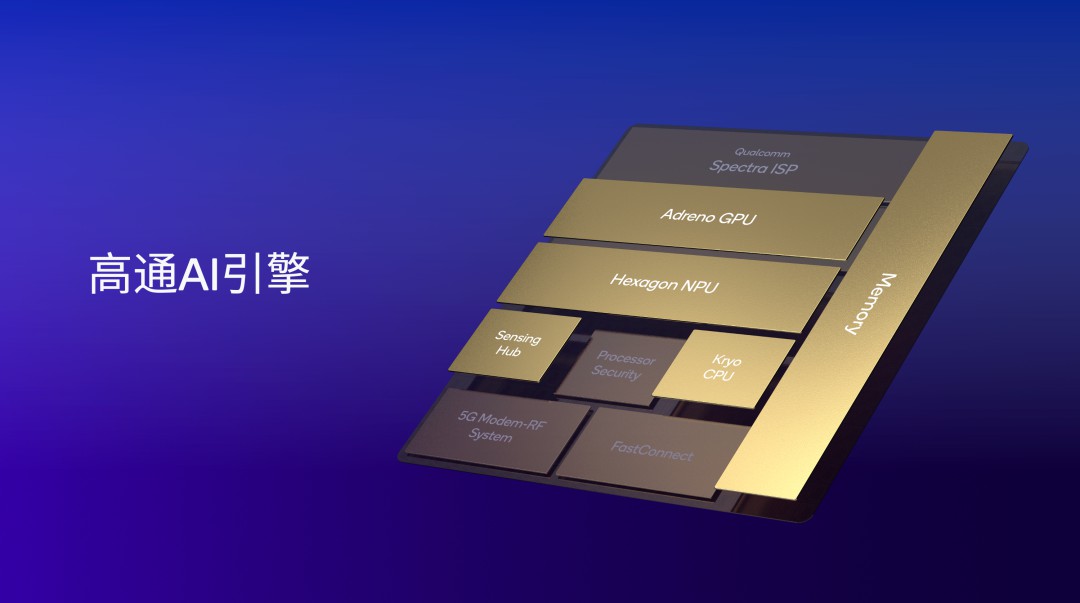

高通AI引擎包括高通Hexagon NPU、高通Adreno GPU、高通Kryo或高通Oryon CPU、高通传感器中枢和内存子系统。

高通领先的NPU和异构计算解决方案

高通正在助力让智能计算无处不在。业界领先的高通Hexagon NPU面向以低功耗实现持续稳定的高性能AI推理而设计。高通NPU的差异化优势在于系统级解决方案、定制设计和快速创新。通过定制设计NPU并控制指令集架构,高通能够快速进行设计演进和扩展,以解决瓶颈问题并优化性能。

Hexagon NPU是高通业界领先的异构计算架构——高通AI引擎中的关键处理器,高通AI引擎还包括高通Adreno GPU、高通Kryo或高通Oryon CPU、高通传感器中枢和内存子系统。这些处理器为实现协同工作而设计,能够在终端侧快速且高效地运行AI应用。

我们在AI基准测试和实际生成式AI应用方面的行业领先性能表现就是例证。深入了解高通NPU、我们的其他异构处理器,以及在第三代骁龙8和骁龙X Elite上业界领先的Al性能。 可以登录高通网站。

高通AI软件栈旨在帮助开发者一次编写,即可实现随时随地运行和规模化扩展。

赋能开发者加速生成式Al应用

我们专注于在全球搭载高通和骁龙平台的数十亿终端设备上实现便捷开发和部署,赋能开发者。利用高通AI软件栈,开发者可在高通硬件上创建、优化和部署AI应用,一次编写即可实现在不同产品和细分领域采用高通芯片组解决方案进行部署。

通过将技术领导力、定制芯片设计、全栈AI优化和生态系统赋能充分结合,高通技术公司在推动终端侧生成式AI开发和应用方面独树一帜。高通技术公司正在赋能终端侧生成式AI的规模化扩展。

本文内容来自高通技术公司高级副总裁兼技术规划和边缘解决方案业务总经理马德嘉、高通技术公司技术市场总监Pat Lawlor的署名博客。

*骁龙和高通品牌产品是高通技术公司和/或其子公司的产品。