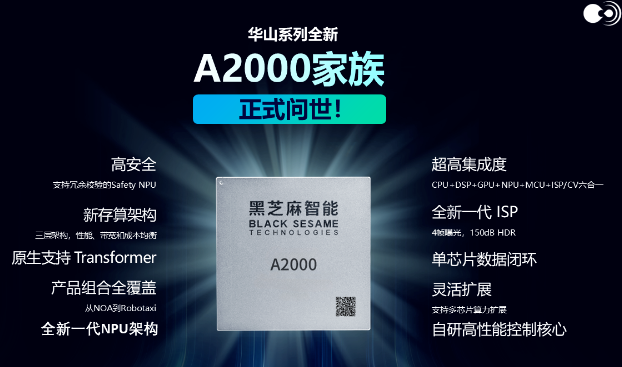

黑芝麻智能A2000芯片是面向下一代AI模型设计的车规级高算力芯片平台,旨在推动全场景通识智驾的普及与高阶自动驾驶技术的突破。以下从技术架构、性能特点、应用场景及市场定位等多维度进行详细解析:

一、产品定位与核心目标

A2000家族是黑芝麻智能华山系列的最新产品, 定位于高阶智能驾驶与通用AI计算 ,目标是通过高算力、高能效的芯片设计,解决自动驾驶场景中的复杂决策与感知需求,并支持机器人和边缘计算等泛AI领域。其核心创新在于**“全场景通识智驾”**概念,即通过知识增强的语义空间,让AI模型具备类人类常识的推理能力,覆盖城市道路、高速、昼夜及极端天气等多样化场景。

二、技术架构与核心创新

-

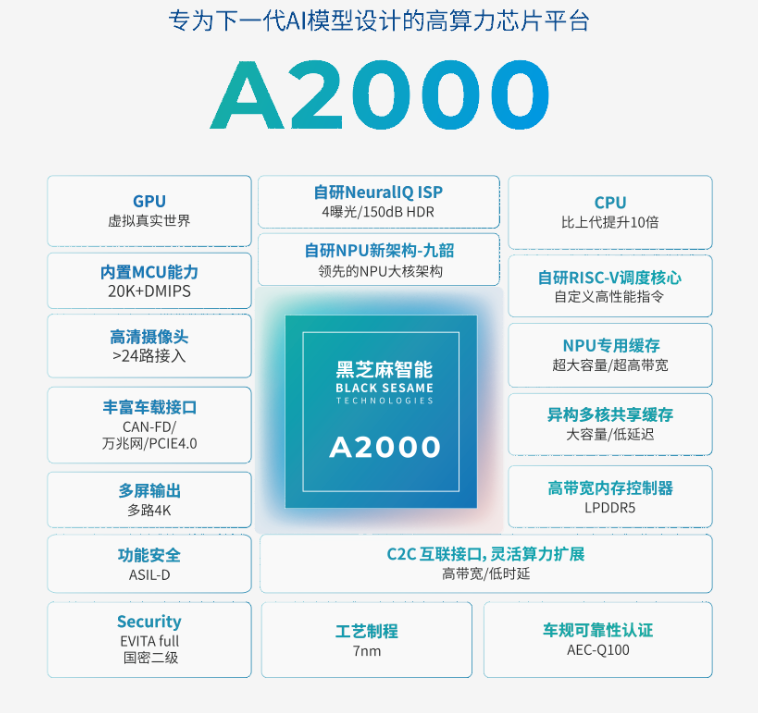

自研NPU架构“九韶”

- 大核设计 :支持Transformer模型硬加速,优化大模型实时推理效率,降低延迟(如端到端推理延迟缩短至毫秒级)。

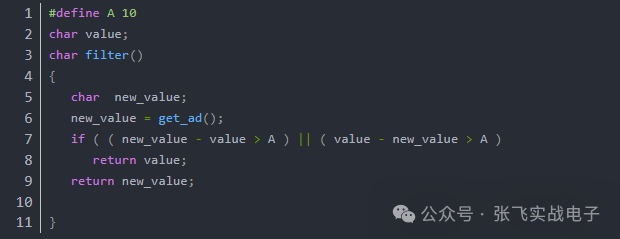

- 混合精度支持 :兼容INT8/FP8/FP16等数据类型,集成高精度量化和Transformer硬件加速模块,简化开发者部署流程。

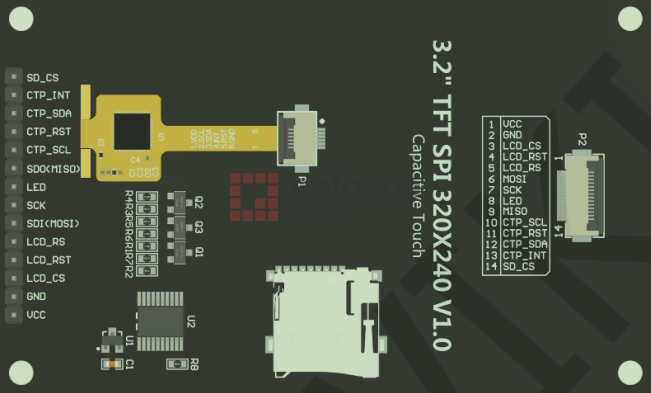

- 三层内存架构 :包含NPU专用缓存、共享缓存及对称双数据通路,提升有效带宽并降低对外部存储依赖,平衡性能与成本。

- 安全等级 :通过ASIL-D功能安全认证,避免模型推理中的随机错误,确保自动驾驶系统的确定性。

-

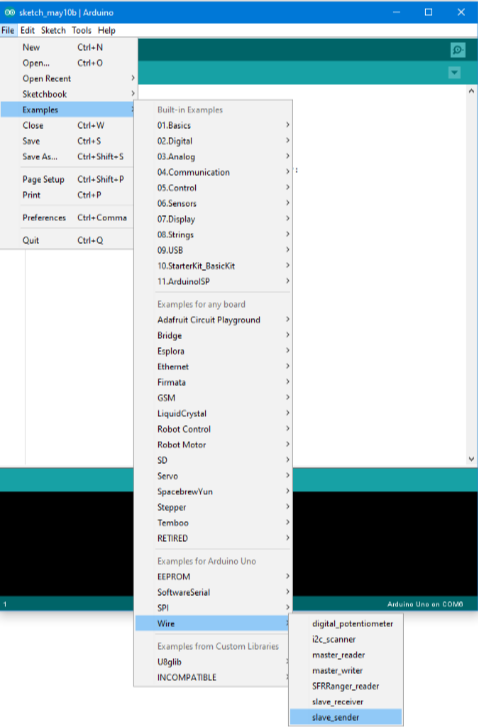

工具链与互联技术

- BaRT工具链 :支持PyTorch、TensorFlow等主流框架,原生兼容PyTorch推理API,允许Python编程部署,并支持Triton自定义算子自动化编译。

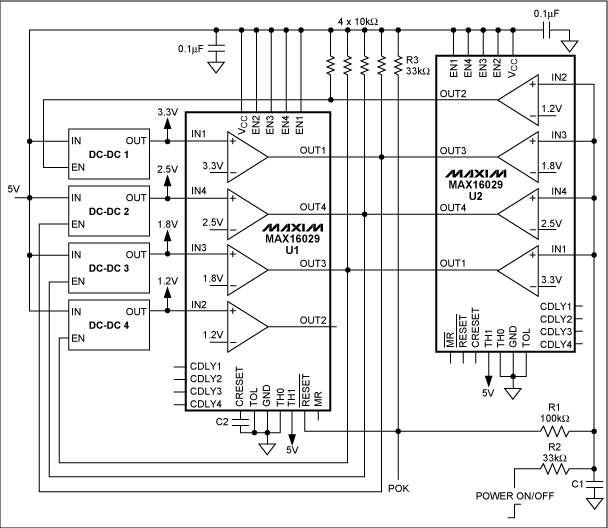

- BLink双芯粒互联 :基于Cache一致性的C2C技术,支持多芯片算力扩展(单芯片算力256-1000 TOPS),满足大规模模型需求。

三、性能参数与对比优势

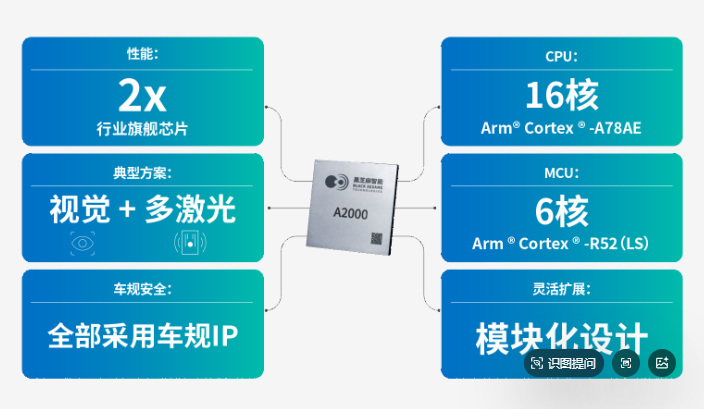

- 算力与能效 :A2000家族最高算力达1000 TOPS,是当前主流芯片(如英伟达Orin-X)的4倍,能效比提升30%以上。

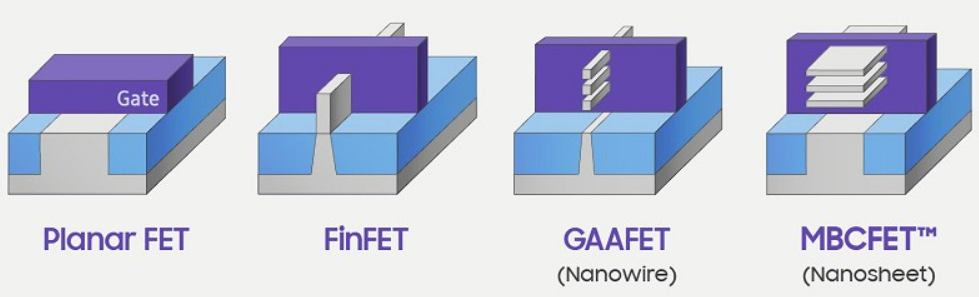

- 工艺与效率 :采用7nm工艺,通过架构优化实现与4nm芯片(如英伟达Thor)相当的性能,模型推理效率达328 FPS(ResNet-50),超越Thor的300 FPS。

- 灵活扩展性 :支持单芯片部署或多芯片互联,覆盖从NOA(导航辅助驾驶)到Robotaxi(无人出租车)的广泛场景。

四、产品组合与应用场景

-

产品线细分

- A2000 Lite :专注城市智驾,支持基础感知与决策。

- A2000 :全场景通识智驾,覆盖复杂城市与高速路况。

- A2000 Pro :针对高阶全场景需求,支持L4级自动驾驶及多模态大模型部署。

-

应用领域

- 智能汽车 :支持单芯片实现城市NOA+数据闭环,覆盖记忆泊车、自主导航等功能,已与东风、吉利等车企合作量产。

- 机器人 :满足“大小脑”计算需求(如具身智能机器人),与武汉大学、傅利叶等团队合作开发智能机器狗等应用。

- 通用计算 :赋能智慧交通、边缘服务器及AI推理卡,兼容阿里云通义千问大模型。

五、市场竞争与行业影响

- 对比国际竞品 :A2000在算力、能效及成本上具备优势,尤其在Transformer模型支持方面优于英伟达Orin系列。

- 车企合作模式 :黑芝麻智能采取开放合作策略,提供定制化算法服务与中间件,降低车企开发门槛,与地平线、华为形成差异化竞争。

- 量产计划 :预计2026年实现大规模量产,已获得多家头部Tier 1及车企的定点合作(如东风、均联智行)。

六、总结与展望

A2000芯片通过软硬协同优化,解决了高阶智驾对高算力、低延时及安全性的核心需求,同时布局机器人等新兴领域,推动“计算效率革命”。随着2025年城市NOA渗透率提升至20%,A2000有望成为本土智驾芯片的标杆产品,加速自动驾驶技术从功能叠加到体验升维的转型。

审核编辑 黄宇