有不止一种方法可以获得一个具有超过1万亿个参数的大型语言模型,该模型可以做很多不同的事情,企业可以用来创建人工智能训练和推理基础设施,以扩展和丰富其数千个应用程序。一种是采取一种大爆炸的方法,模仿OpenAI对GPT-4和GPT-5所做的事情,以及谷歌对PaLM和Gemini所做的一切。你创建了一个有数万亿参数的大模型,运行你能通过它找到的最大的知识库,并训练它同时做各种事情。如果你很聪明,你可以得到这样一个可怕的模型,只激活LLM的路径,它需要回答特定类型的问题或给出特定类型的输出。这就是谷歌路径语言模型(PaLM)中的“路径”的来源,它是目前有争议的Gemini模型的前身。训练GPT-4和GPT-5、PaLM或Gemini这样的大模型需要数千到数万个GPU或其他类型的人工智能加速器,他们很容易需要三个月的时间来咀嚼庞大的语料库,并建立所有可以提示它的关系。虽然激活用于推理的模型可以是选择性的,但训练是包罗万象的、巨大的且昂贵的。另一种方法,被人工智能初创公司和新贵SambaNova Systems称为专家组成,是将几十到数百个预训练的模型,这些模型非常擅长完成非常具体的任务,并将它们并行地串在一起,呈现出一个集体,因为它是一个拥有超过一万亿个参数的巨大模型,然后只将工作分配给选定的模型,然后对这些专家的结果进行某种挑选,并将其交叉输入到选定的模型中进行验证和纠错。这种专家组合方法绝非新鲜事,它是一种专家技术的混合,早于深度学习和生成人工智能,是几十年来用于经典贝叶斯机器学习甚至HPC模拟和建模应用的各种集成技术的子集。正如SambaNova联合创始人兼首席执行官Rodrigo Liang去年9月向我们解释的那样,当其第四代可重构数据单元(RDU)“Cerulean-1”SN40L推出时,构建具有数万亿参数和数万亿代币的不断扩大的模型是不可持续的,必须采用一种不同的方法,即为企业中的不同任务提供150个独特的预训练模型,然后在这个LLM集合前面放置一种软件路由器,使其看起来像一个LLM。结果是,在企业中训练这些模型所需的铁要少得多,因为它们已经是开源的,并且已经经过训练,可以针对企业中公司绝对认为专有的特定数据集进行重新训练、调整和修剪。而且,支持这些模型的人工智能推理所需的铁要少得多,因为它们天生就更小,而且也不是同时被激活的。我们可以观察到,当你试图通过添加更多的参数和数据来创建权重,而后者只是试图发现网络流量中的异常、自动化客户支持、编写产品手册或企业中的任何实际任务,从而获得通用人工智能的圣杯时,OpenAI和谷歌采取的前一种方法就会发生。坦率地说,这似乎更类似于人类大脑的实际设计方式——呃,进化。我们有许多不同种类的大脑,它们大多协同工作,以正确的速度提供正确的反应——有时是自主和自动的,就像反射反应一样,有时是需要时间的深层思考。SambaNova专家组成模型的第一次迭代并没有达到预期的最终跨度,但Samba-1集合中的54个模型总共包含1.3万亿个参数。“Samba-1中的54个模型实际上是由我们的工程师策划的,他们在寻找企业客户想要的最好、最准确的专家,”梁告诉下一个平台。“然后我们把它们放在一个单一的终点。通过开源社区,这些基本模型被训练来创建高质量的检查点。当Samba-1运行时,我们调用以响应提示的一个或多个实际模型会被发布,这让客户可以看到。”我们向梁解释说,由于GenAI运动还很年轻,SambaNova为特定类型任务的模型所做的选择很重要,需要列出,以及它们在用于训练这些模型的参数方面的相对大小。因此,SambaNova向我们发送了一个笨拙的电子表格,其中列出了所有54个型号,然后稍晚又发送了一张更漂亮的图形,虽然很高,但它概述了所有64个型号以及它们在集体中的使用方式:正如你所看到的,LLaMA 2型号在Samba-1的第一次迭代中有很大的代表性,还有一些Bloom、Mistral和Falcon型号。有趣的是,没有OpenAI GPT 3.5模型。但请记住,正如梁在9月份向我们解释的那样,在SambaNova达到其认为企业需要的150款左右之前,集体中还有大约100款车型。也许在未来的某个时候会添加预先训练的OpenAI模型(SambaNova确实开始使用早期开放的GPT模型)。但更有可能的是,来自拥抱脸星系的其他模型将被添加进来,该星系目前拥有超过350000个模型和超过75000个数据集。SambaNova本身坚持开源模型,但企业不必这么做。他们可以授权其他模型和数据集在SambaNova自己的设备或基于云的GPU上私下进行自己的训练。您还会注意到,在特定的模型上经常会有一些变化,这些变化是为了速度或准确性而调整的,或者是为了在两者之间保持平衡而调整的。“事情是这样的,”梁说。“我不必相信一个在某种程度上有偏见的模型。我有54个模型。随着我们的路线图不断增加越来越多的专家,你将有越来越多的机会获得不同的观点,让你能够真正地交叉检查你得到的答案。如果你不喜欢一个专家所说的,你可以获得第二种意见,你可以让一个独立的专家来对他们的结果发表意见,并从中进一步迭代,从而得出答案。因此,这对我们来说非常令人兴奋,因为它打开了其他人无法做的事情,因为这些单一的模型在结构上有偏见。”Samba-1前面的秘密酱汁模型集合在内部被称为“the Conductor”,它是提示和54个模型之间的路由软件,基于提示,它知道哪些模型可以通过输入激活,哪些模型可以聚合输出——重要的是,由于计算能力和延迟的原因,哪一个该离开。梁说,这不是一个很大的软件,可能包括数千行代码,但肯定不是像其他系统软件那样可以膨胀到数百万或数千万。但路由软件仍然有点棘手,我们将其命名为Router-1,因为每个产品都必须有一个正式的名称。目前尚不清楚SambaNova是否会开源该路由器,以便其他人可以创建自己的专家组成。大概不会。但这个想法已经存在,如果这种方法效果良好,你可以打赌有人会开始编码一个开源LLM路由器。或者,也许人们只会购买SambaNova iron并在他们的数据中心运行它,或者在SambaNovaCloud上租用容量,然后就可以开始工作了。这就是梁认为会发生的事情,他为SambaNov设定了一个目标,即今年向财富500强中的100家企业销售使用Samba-1堆栈的系统。当然,目标实际上是全球2000年,在那里,除了超级规模和云构建商之外,所有最大的资金都花在了IT部门。这些超级规模和云构建者在昂贵的GPU中如鱼得水,目前他们也在构建自己的人工智能加速器。目前,SambaNova有几十个付费客户,去年的收入几乎增加了两倍,考虑到专家组的这种组成,以及SambaNova相信它可以以十分之一的成本(大约十分之一的铁)获得与整体模型相同的结果,今年可能是SambaNovaa开始走上曲棍球棒曲线的一年,达到数百个客户和数亿美元的收入,然后是数千个客户和数十亿美元的收入。注册我们的时事通讯,将本周的精彩内容、分析和故事直接从我们发送到您的收件箱,中间没有任何内容。

推荐

-

VCSEL芯片和光学解决方案提供商瑞识科技完成近亿元B1轮融资

VCSEL芯片和光学解决方案提供商瑞识科技完成近亿元B1轮融资

2023-07-03

-

一文带你搞懂开关电源电路

一文带你搞懂开关电源电路

2024-11-02

-

基于脱硝系统改造的自动化优化分析

基于脱硝系统改造的自动化优化分析

2025-02-20

-

阿诗特能源L1000液冷新品震撼上市,卓越性能,引领未来!

阿诗特能源L1000液冷新品震撼上市,卓越性能,引领未来!

2024-06-15

-

博世与芯驰科技全面深化战略合作 围绕车用半导体核心技术

博世与芯驰科技全面深化战略合作 围绕车用半导体核心技术

2025-04-10

-

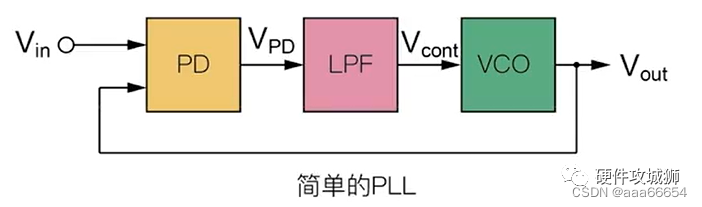

PLL锁相环:工作原理简述,高效同步控制的核心技术。

PLL锁相环:工作原理简述,高效同步控制的核心技术。

2024-04-07

-

中科曙光助力北京航天总医院打造24小时在线的AI医疗助手

中科曙光助力北京航天总医院打造24小时在线的AI医疗助手

2025-04-10

-

国产替代奋进高端,创新引领,开启替代新篇章。

国产替代奋进高端,创新引领,开启替代新篇章。

2024-04-07

-

模拟芯片与数字芯片各有独特优势,各具魅力,吸引你的目光。

模拟芯片与数字芯片各有独特优势,各具魅力,吸引你的目光。

2024-03-06

-

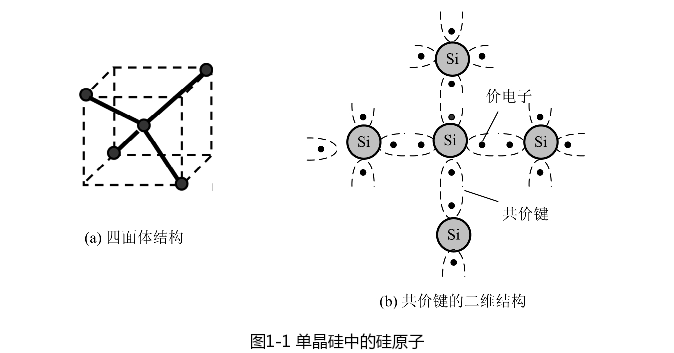

本征半导体,基础材料之选,了解它,掌握电子世界的关键!

本征半导体,基础材料之选,了解它,掌握电子世界的关键!

2024-04-07

最近更新

-

基于SiWG917Y的无电池Wi 6传感器

基于SiWG917Y的无电池Wi 6传感器

2025-04-19

-

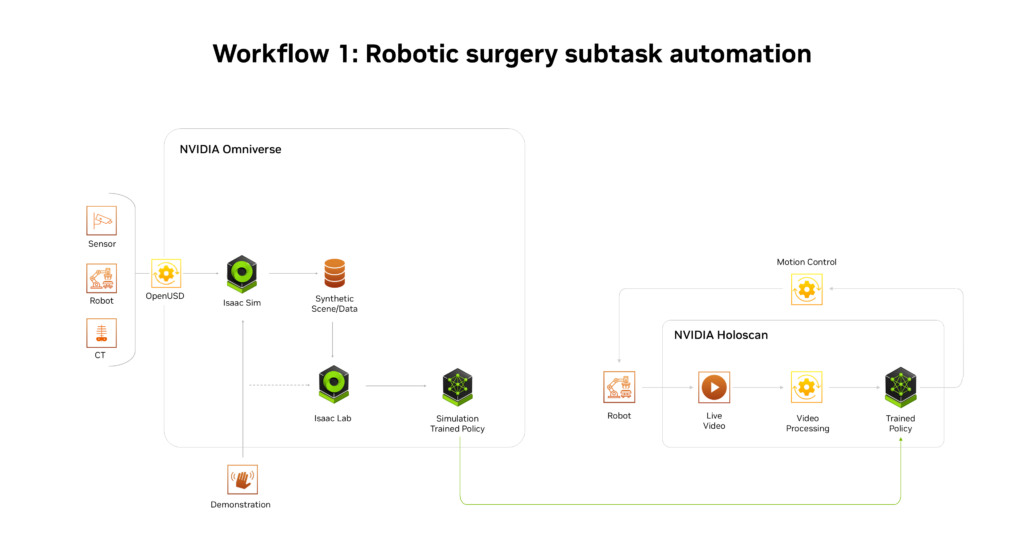

NVIDIA推出AI医疗健康机器人开发平台

NVIDIA推出AI医疗健康机器人开发平台

2025-04-19

-

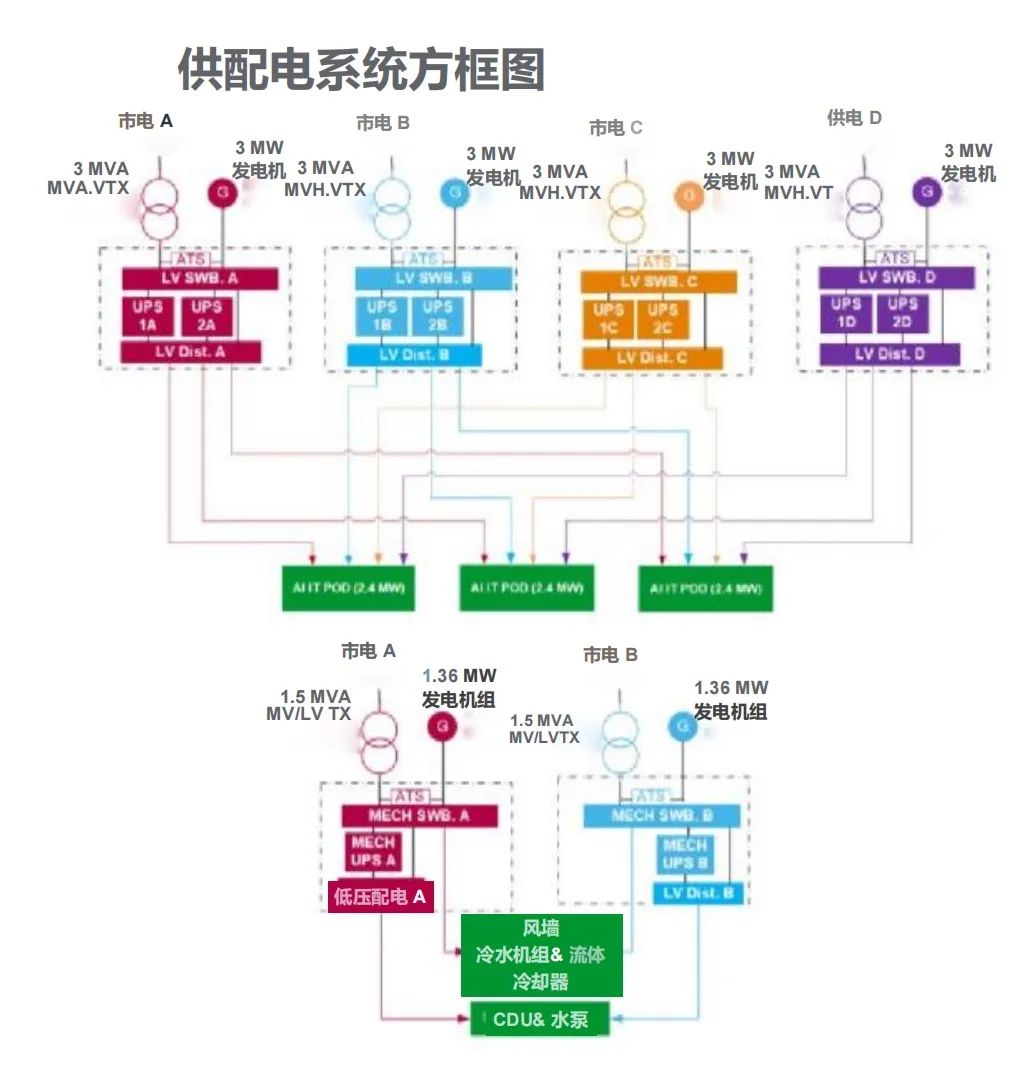

施耐德电气发布数据中心高密度AI集群部署解决方案

施耐德电气发布数据中心高密度AI集群部署解决方案

2025-04-19

-

航裕电源亮相2025慕尼黑上海电子展

航裕电源亮相2025慕尼黑上海电子展

2025-04-19

-

RECOM RACPRO1系列荣获2025年红点产品设计奖

RECOM RACPRO1系列荣获2025年红点产品设计奖

2025-04-19

-

广汽昊铂首家直营交付中心开业

广汽昊铂首家直营交付中心开业

2025-04-19

-

季丰成都实验室开启芯片微加工新篇章

季丰成都实验室开启芯片微加工新篇章

2025-04-19

-

航裕电源亮相2025俄罗斯国际电子元器件展

航裕电源亮相2025俄罗斯国际电子元器件展

2025-04-19

-

施耐德电气新型电力系统创新中心正式启用

施耐德电气新型电力系统创新中心正式启用

2025-04-19

-

格陆博科技2025上海车展亮点前瞻

格陆博科技2025上海车展亮点前瞻

2025-04-19