来源:Coggle数据科学

神经网络模型使用随机梯度下降进行训练,模型权重使用反向传播算法进行更新。通过训练神经网络模型解决的优化问题非常具有挑战性,尽管这些算法在实践中表现出色,但不能保证它们会及时收敛到一个良好的模型。

使用反向传播设计和训练网络需要做出许多看似任意的选择,例如节点的数量和类型、层的数量、学习率、训练和测试集等。这些选择可能至关重要,但却没有百分之百可靠的决策法则,因为它们在很大程度上取决于问题和数据。训练神经网络模型的目标最具挑战性,因为它要解决两个难题>

在这些问题之间存在权衡,因为学得太好的模型泛化能力可能较差,而泛化良好的模型可能欠拟合。训练神经网络的目标是在这两方面找到一个良好的平衡。在拟合神经网络模型时,这些术语可以定义为>

方差:衡量网络输出在数据集之间变化的程度。

这种表述将模型的容量定义为偏差的选择,控制可以学习的函数范围。它将方差视为训练过程的函数,并在过拟合训练数据集和泛化误差之间取得平衡。

然而,如果训练时间太长,网络还将学到特定数据集的噪声,这称为过度训练。在这种情况下,方差将很大,因为噪声在数据集之间变化。

随机梯度下降,也称为在线梯度下降,是指从训练数据集中随机选择一个示例,估算误差梯度,然后更新模型参数的算法版本。它的效果是快速训练模型,尽管可能会导致模型权重的大幅、嘈杂的更新。

通常情况下,基本反向传播首选随机学习,原因有三>

批量梯度下降涉及使用训练数据集中所有示例的平均值来估算误差梯度。它执行更快,从理论上更容易理解,但导致学习速度较慢。

尽管随机学习具有诸多优势,仍有理由考虑使用批量学习>

对权重动态和收敛速率的理论分析更简单。

尽管批量更新具有优势,但在处理非常大的数据集时,随机学习仍然通常是首选方法,因为它更简单更快。

神经网络从最意外的样本中学得最快。因此,建议在每次迭代中选择对系统最不熟悉的样本。实现这个技巧的一个简单方法是确保用于更新模型参数的连续示例来自不同的类别。

这个技巧也可以通过向模型展示并重新展示它在进行预测时犯的最多错误或产生最多错误的示例来实现。这种方法可能是有效的,但如果在训练期间过度表示的示例是离群值,它也可能导致灾难。

选择信息内容最大的示例>

更频繁地呈现产生大误差的输入示例,而不是产生小误差的示例。

当训练数据集中的示例总和为零时,神经网络通常学得更快。这可以通过从每个输入变量中减去平均值来实现。通常,如果训练集上每个输入变量的平均值接近零,收敛速度会更快。

此外将输入居中也会提高模型对来自先前层的输入到隐藏层的收敛性。这是令人着迷的,因为它为后来近15年发展并广泛流行的批量归一化技术奠定了基础。

因此,最好将输入移动,以使训练集的平均值接近零。这个启发式方法应该应用于所有层,这意味着我们希望节点的输出的平均值接近零,因为这些输出是下一层的输入。

转换输入

如果可能的话,输入变量应该无关联。

非线性激活函数赋予神经网络非线性能力。其中一种最常见的激活函数形式是 Sigmoid。

在隐藏层使用 logistic 和 tanh 激活函数不再是一个合理的默认选择,因为使用 ReLU 的性能模型收敛速度更快。

在二元分类问题的情况下,目标变量可能是 logistic 激活函数的渐近值集合 {0, 1},或者是双曲正切函数的渐近值集合 {-1, 1},分别对应使用交叉熵或铰链损失函数,即使在现代神经网络中也是如此。在激活函数的饱和点取得值可能需要更大的权重,这可能使模型变得不稳定。

权重的初始值对训练过程有很大影响。权重应该随机选择,但以 sigmoid 函数的线性区域为主要激活区域。这个建议也适用于 ReLU 的权重激活,其中函数的线性部分是正的。

初始权重对模型学习有重要影响,其中大权重使激活函数饱和,导致不稳定的学习,而小权重导致梯度非常小,进而学习缓慢。理想情况下,我们寻求模型权重位于激活函数的线性部分之上。

学习率是模型权重在算法的每次迭代中更新的量。较小的学习率可能导致收敛较慢,但可能得到更好的结果,而较大的学习率可能导致更快的收敛,但可能得到不太理想的结果。

建议当权重值开始来回变化,例如振荡时,减小学习率。

显然,为网络中的每个权重选择不同的学习率可以提高收敛性。[…] 主要思想是确保网络中的所有权重大致以相同的速度收敛。

推荐

-

VCSEL芯片和光学解决方案提供商瑞识科技完成近亿元B1轮融资

VCSEL芯片和光学解决方案提供商瑞识科技完成近亿元B1轮融资

2023-07-03

-

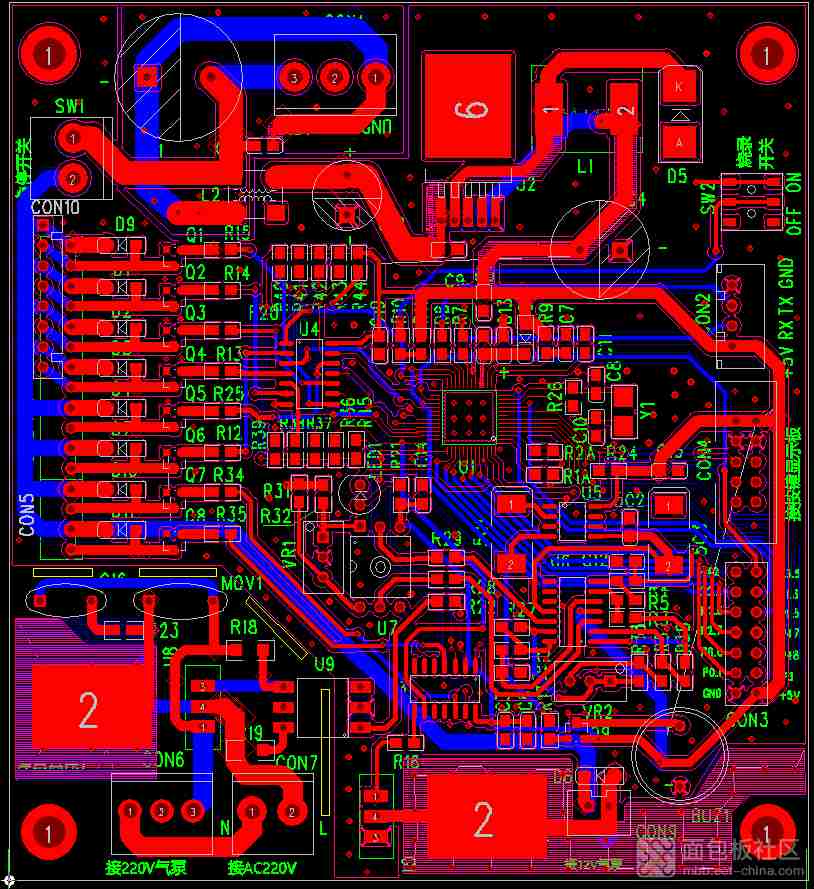

一文带你搞懂开关电源电路

一文带你搞懂开关电源电路

2024-11-02

-

基于脱硝系统改造的自动化优化分析

基于脱硝系统改造的自动化优化分析

2025-02-20

-

阿诗特能源L1000液冷新品震撼上市,卓越性能,引领未来!

阿诗特能源L1000液冷新品震撼上市,卓越性能,引领未来!

2024-06-15

-

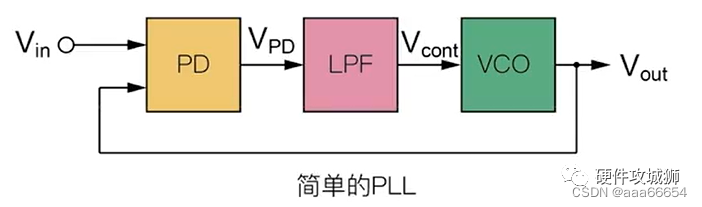

PLL锁相环:工作原理简述,高效同步控制的核心技术。

PLL锁相环:工作原理简述,高效同步控制的核心技术。

2024-04-07

-

国产替代奋进高端,创新引领,开启替代新篇章。

国产替代奋进高端,创新引领,开启替代新篇章。

2024-04-07

-

模拟芯片与数字芯片各有独特优势,各具魅力,吸引你的目光。

模拟芯片与数字芯片各有独特优势,各具魅力,吸引你的目光。

2024-03-06

-

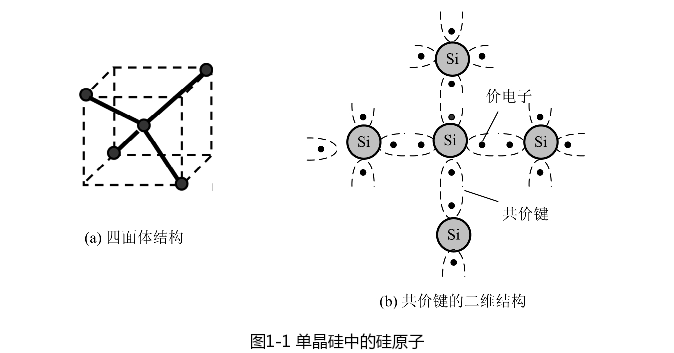

本征半导体,基础材料之选,了解它,掌握电子世界的关键!

本征半导体,基础材料之选,了解它,掌握电子世界的关键!

2024-04-07

-

STM32单片机简介

STM32单片机简介

2023-07-26

-

国产化加速,GE医疗MR东半球总部落户,共创医疗新篇章!

国产化加速,GE医疗MR东半球总部落户,共创医疗新篇章!

2024-03-24

最近更新

-

安富利荣获云尖信息2024年度优秀供应商奖

安富利荣获云尖信息2024年度优秀供应商奖

2025-04-10

-

博世与芯驰科技全面深化战略合作 围绕车用半导体核心技术

博世与芯驰科技全面深化战略合作 围绕车用半导体核心技术

2025-04-10

-

中科曙光助力北京航天总医院打造24小时在线的AI医疗助手

中科曙光助力北京航天总医院打造24小时在线的AI医疗助手

2025-04-10

-

燧原科技出席2025年“智算申城”高峰论坛

燧原科技出席2025年“智算申城”高峰论坛

2025-04-10

-

TouchGFX是什么?TouchGFX有哪些优异功能?

TouchGFX是什么?TouchGFX有哪些优异功能?

2025-04-10

-

微控制器基本结构是什么样的?STM32WL33系列无线微控制器功耗设计如何?

微控制器基本结构是什么样的?STM32WL33系列无线微控制器功耗设计如何?

2025-04-10

-

盘点影响着信号完整性的致命因素

盘点影响着信号完整性的致命因素

2025-04-10

-

何为微控制器?微控制器的工作流程具体是什么样的?

何为微控制器?微控制器的工作流程具体是什么样的?

2025-04-10

-

你了解Stellar系列MCU吗?Stellar系列MCU专为集成式应用设计!

你了解Stellar系列MCU吗?Stellar系列MCU专为集成式应用设计!

2025-04-10

-

车规MCU有哪些分类?车规MCU有哪些特点?

车规MCU有哪些分类?车规MCU有哪些特点?

2025-04-10