性能拼不动了,必须上AI竞争

掌握智能入口的一方,就能成为应用的真正入口。

硬件进化了好多年,现在到了软件定义手机的新节点。

大模型会和手机厂商自研的操作系统深度结合,提供更好的系统级体验,这很关键。

手机软件体验上的差异,可以解决现在手机厂商们硬件差不多、只能靠外观来区分的问题。

大模型的竞争,会让手机产品的[智力水平]表现出来,这也是为什么手机厂商们现在热衷于大模型的原因之一。

从AI定义汽车到AI定义手机、PC,大模型的注入会改变手机市场的销量格局。

以前因为硬件配置过剩,有人一部手机用5年都不换,大模型的升级体验可能会让人有换机的理由,从而带动手机行业的销售增长。

手机大厂无不例外,加入新一轮竞赛

在7月,荣耀手机推出了一款名为Magic V2的折叠屏手机,该手机自称是全球首款原生的集成AI大模型的国产手机。

在10月,荣耀CEO赵明宣布,荣耀Magic6系列将搭载第三代骁龙8移动平台,并支持70亿参数的端侧AI大模型。

在8月的华为开发者大会上,华为终端BG CEO余承东宣布,盘古大模型已经接入华为HarmonyOS 4及华为小艺智慧助手。

这意味着华为P60和Mate 60用户可以通过小艺智能助手体验这一大模型的功能。

同一个月,小米创始人、董事长兼CEO雷军发布了小米自研的两个轻量级大模型MiLM,参数分别为64亿和13亿。

在10月底,小米正式推出了将AI大模型植入澎湃OS系统的小米14手机。

OPPO在10月宣布了自主训练的AI大模型——安第斯大模型,该模型已经接入新小布助手AndesGPT。

预计在12月前,AndesGPT的能力将被正式接入ColorOS 14新系统。

在11月,vivo发布了旗舰新品X100系列,声称这是全球首个百亿大模型在终端调通的大模型手机。

而三星则在11月展示了其AI大模型[高斯]。预计搭载这一AI大模型的Galaxy S24系列手机要到明年上半年才会发售。

至于苹果,目前还没有官宣其AI大模型的消息。但据分析,苹果计划最早在2024年年底将生成式AI技术整合到iPhone和iPad中。

选择端侧部署,看上去最划算

当前,AI大模型接入手机存在两种选择:云端部署和端侧部署。

目前,大多数厂商选择在端侧部署轻量级大模型,而在云端部署的则是千亿级AI大模型。

为了平衡内存、执行速度、功耗和成本等问题,现阶段的[端云协同]是手机厂商部署大模型时的普遍选择。

手机厂商想要实现大野心,端侧大模型可是个好工具。

要知道,手机厂商不提供云服务,也就没法拿到便宜的云服务。

而要满足亿万用户的需求,背后得有强大算力支持,这可不好办。

好在端侧大模型可以让手机厂商省下这笔钱,让商业计划更靠谱。

另外,手机厂商在用端侧AI上可是有优势的。

像华为、小米、VIVO 这些厂家,都是自研的大模型。

在出厂前,手机和芯片公司就得跟它调整好多次,让它跟硬件更匹配。

现在端侧大模型很依赖内存,手机厂商也能优先给自己的终端大模型用内存。

如果需要调用云端大模型的话成本非常高,但如果在手机端侧运行大模型,则不会产生推理成本。

云端部署用于解决复杂的需要大算力、大参数模型的问题;,而端侧部署则主要用于运行数据安全性高、需要实时反馈、网络条件较差的轻量化问题。

综上所述,手机厂商在布局AI大模型时通常会选择云端和端侧的协同部署方式。

芯片厂商懂客户诉求,尽可能满足AI需求

就像手机镜头一样,生成式模型的支持能力可能会成为核心硬件卖点。

生成式模型的最终解决方案需要软硬件结合设计,这对于有自研芯片能力的手机厂商非常有利。

因为这些手机厂商可以同时掌握模型和硬件的设计,实现最高效率的解决方案。

给手机系统做芯片的公司,像高通和联发科,得提供完整的参考设计。

说到高通,他们把手机端的生成式模型搞到了核心位置。

例如,高通发布的骁龙8 gen3支持包括Meta Llama2、Chat GPT等在内的多模型生成式AI。

其可处理的大模型参数超过100亿,推理速度达到了每秒20个token。

此外,联发科发布生成式AI移动芯片天玑9300,集成第七代AI处理器APU 790,支持在终端运行10亿、70亿、130亿参数的AI大模型。

结合内存硬件压缩技术NeuroPilot Compression来减少AI大模型对终端内存的占用;,联发科的AI开发平台NeuroPilot支持Android、Meta Llama 2、百度文心一言大模型、百川智能百川大模型等主流AI大模型。

英伟达在手机芯片方面的尝试,自从十多年前的Tegra系列之后,好像就没什么动静了。

但是,今年听说英伟达要跟联发科合作,联发科的下一代旗舰手机芯片可能会用英伟达的GPU。

看来,英伟达在手机生成式模型领域还是有机会的。

厂商口中的“大”,现阶段有待商榷

为了让大型AI模型适应手机,制造商不得不采取一些策略对其进行大幅压缩,例如通过剪枝、蒸馏和量化等技术手段。

以vivo为例,他们可能通过连续的模型裁剪和蒸馏,将参数从1750亿降低到仅10亿,这种操作是否过于牵强。

我们应该认识到,大型AI模型并不仅仅是参数数量的简单叠加,它的真正价值在于深度学习中的[深度]。

因此,当把一款千亿参数的模型剪裁到几十亿参数时,势必会失去一些原有的学习深度。

对于AI的日常应用来说,可能影响不大,但对于那些期望从AI获得深度见解和理解的高端用户来说,这种损失是无法接受的。

即便小米宣称其端侧模型能与云端模型相提并论,但这其中的细节仍不容忽视。

拥有13亿参数的端侧模型自然难以与拥有千亿参数的云端模型相比。

从这些层面出发,当前手机上的大型AI模型实现方式似乎有点[矫枉过正]。

对于普通用户而言,他们并不真正关心模型的参数数量,而更关心能为他们带来什么价值。

vivo和小米的这些尝试固然值得鼓励,但也应该反思其真正的目的和意义。

结尾:

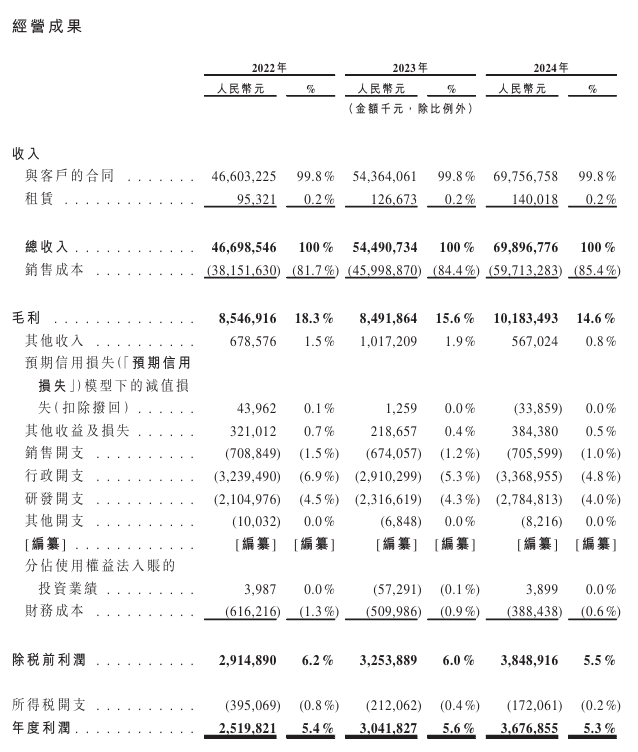

当然,自研大模型是个[无限烧钱]的竞争,投入动辄数十亿元起。

投入大模型需要强大资金储备做后盾,以大模型驱动手机软、硬件的每一次进化背后都是[钞能力]。

但无可否认,在智能手机出货量持续下滑的行业态势下,大模型或许会成为手机行业突破自身创新窘境和模式局限性的一个机遇。

推荐

-

黄仁勋中国行的背后,AI芯片暗战与英伟达生存博弈

黄仁勋中国行的背后,AI芯片暗战与英伟达生存博弈

2025-04-19

-

国民技术发布国内首款Arm® Cortex®M7+M4双核异构MCU 面向具身智能机器人

国民技术发布国内首款Arm® Cortex®M7+M4双核异构MCU 面向具身智能机器人

2025-04-19

-

北京机器人传感器公司金钢科技数千万元Pre

北京机器人传感器公司金钢科技数千万元Pre

2025-04-19

-

光子 AI 处理器的核心原理及突破性进展

光子 AI 处理器的核心原理及突破性进展

2025-04-19

-

解决续航、网速痛点,Wi 7 PA杀入AI眼镜

解决续航、网速痛点,Wi 7 PA杀入AI眼镜

2025-04-19

-

15万车型也能有车规SiC!2025年慕展6家厂商新品亮点大揭秘

15万车型也能有车规SiC!2025年慕展6家厂商新品亮点大揭秘

2025-04-19

-

VCSEL芯片和光学解决方案提供商瑞识科技完成近亿元B1轮融资

VCSEL芯片和光学解决方案提供商瑞识科技完成近亿元B1轮融资

2023-07-03

-

算法进化论:从参数剪枝到意识解码的 AI 革命

算法进化论:从参数剪枝到意识解码的 AI 革命

2025-04-19

-

一文带你搞懂开关电源电路

一文带你搞懂开关电源电路

2024-11-02

-

基于脱硝系统改造的自动化优化分析

基于脱硝系统改造的自动化优化分析

2025-02-20

最近更新

-

研华AgentBuilder智能体平台推动智能制造发展

研华AgentBuilder智能体平台推动智能制造发展

2025-04-23

-

新能源汽车热管理系统,从电容、传感器到功率器件的全面创新

新能源汽车热管理系统,从电容、传感器到功率器件的全面创新

2025-04-23

-

奥托立夫助力长城魏牌全新高山重塑家庭出行安全范式

奥托立夫助力长城魏牌全新高山重塑家庭出行安全范式

2025-04-23

-

蓝思科技港股IPO破局:人形机器人+AI设备拓新赛道减"苹果依赖"

蓝思科技港股IPO破局:人形机器人+AI设备拓新赛道减"苹果依赖"

2025-04-23

-

上汽通用汽车别克品牌与Momenta达成战略合作

上汽通用汽车别克品牌与Momenta达成战略合作

2025-04-23

-

IBM发布2025年X

IBM发布2025年X

2025-04-23

-

比亚迪五款新能源车型登陆塞舌尔市场

比亚迪五款新能源车型登陆塞舌尔市场

2025-04-23

-

仰望汽车累计销量突破10000台

仰望汽车累计销量突破10000台

2025-04-23

-

中车时代电气出席2025年全路ATP车载设备技术交流会

中车时代电气出席2025年全路ATP车载设备技术交流会

2025-04-23

-

比亚迪海狮07EV荣获EURO NCAP和A

比亚迪海狮07EV荣获EURO NCAP和A

2025-04-23